UnitBox: An Advanced Object Detection Network

代码在mmdetection中有实现

Motivation

现有的deep CNN方法假设对象界限为四个自变量,分别通过l2损失进行回归。这种过于简化的假设与广为接受的观察结果相反,即这些变量是相互关联的,从而导致定位不准确(什么是广为接受的观察),提出用IOU损失来代替L2损失进行回归

关于其他论文的一些观点

fasterrcnn对于小目标检测下偶偶不好,因为锚框的尺度和比例是预设的,对目标的形状变换适应力不高。DenseBox是优化点到四条边的距离,用l2损失

如上图,直观地来看这四个变量应该是相关的,应该联合起来回归。并且Densebox需要图片金字塔才能检测,速度慢。

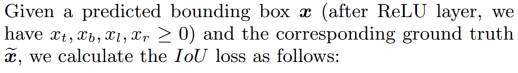

IoU损失

迫使gt和预测框有最大的IOU

对每个像素点预测这些变量

l2损失的缺点

1.是在优化四个独立的变量,没有利用四个变量的相关性

2.在给定两个像素的情况下,其中一个落入大的gt中,另一个落入小的gt中,前者会有更大的损失。l2的性质(用smoothl1就可以解决)

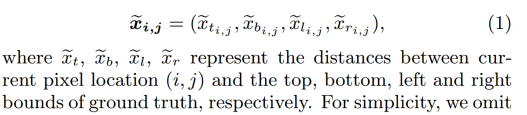

iou损失forward过程

表示当前位置落入了gt范围中

就是求相交面积

跟iou求法相似,很好理解。

利用了四个变量的相关性,同时不论bbox的尺度大小,输出的iou损失总是在0-1之间。

反传推导

可以看到惩罚来自两个部分,一个是预测框四个变量占了反传梯度的一定比例,另外还有对于gt和预测框相交区域I进行了惩罚。为了减小IOU损失,公式7会尽可能的去增大相交面积,同时预测更小的box。

UNITBOX NETWORK

结构已经十分过时,不在讨论。