一.安装虚拟机环境

Vmware12中文官方版 链接:https://pan.baidu.com/s/1IGKVfaOtcFMFXNLHUQp41w 提取码:6rep

激活秘钥:MA491-6NL5Q-AZAM0-ZH0N2-AAJ5A

这个安装就十分的简单了,只需要不断点击下一步,直到安装完成就OK了;

二.虚拟机的安装(Centos7)

这个步骤我分享一个详细安装地址:https://www.cnblogs.com/tony-hyn/p/9677902.html

三.搭建集群

(1)配置服务器(我这里是以3台为例)

1个主节点:Mage1(192.168.102.135),2个(从)子节点,Mage2(192.168.102.136),Mage3(192.168.102.137)

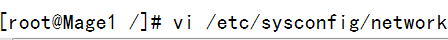

(2)配置主节点名(192.168.102.135)

在命令行输入: vi /etc/sysconfig/network

添加内容:

NETWORKING=yes

HOSTNAME=Mage1

配置两台子节点名(192.168.102.136)和(192.168.102.137):

vi /etc/sysconfig/network

添加内容:

NETWORKING=yes

HOSTNAME=Mage2

vi /etc/sysconfig/network

添加内容:

NETWORKING=yes

HOSTNAME=Mage3

(3)配置hosts

打开主节点的hosts文件,将文件的前两行注释掉 (注释当前主机的信息)并在文件中添加所有hadoop集群的主机息。

在命令行输入: vi /etc/hosts

添加3台服务器的节点名信息

192.168.102.135 Mage1

192.168.102.136 Mage2

192.168.102.137 Mage3

保存之后,将主节点的hosts分别拷贝到其他两个子节点

命令行分别输入:

scp /etc/hosts root@192.168.102.136:/etc/

scp /etc/hosts root@192.168.102.137:/etc/

然后分别执行(重启服务器也可以不执行下面的语句): /bin/hostname hostsname

例如:master上执行 /bin/hostsname master,使之生效。

(4)关闭防火墙

1.查看防火墙状态

firewall-cmd --state

2.停止firewall

systemctl stop firewalld.service

3.禁止firewall开机启动

systemctl disable firewalld.service

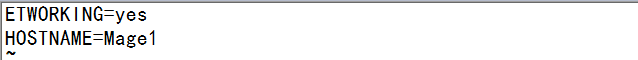

(5)时间同步

命令行输入:yum install ntp 下载ntp插件 ,

下载完成后 命令行输入:ntpdate -u ntp1.aliyun.com

然后命令行输入:date

如果出现如下情况表示配置成功:

(6)配置ssh无密码访问

生成公钥密钥对

在每个节点上分别执行:

命令行输入:ssh-keygen -t rsa

一直按回车直到生成结束

执行结束之后每个节点上的/root/.ssh/目录下生成了两个文件 id_rsa 和 id_rsa.pub

其中前者为私钥,后者为公钥

在主节点上执行:

命令行输入:cp id_rsa.pub authorized_keys

将子节点的公钥拷贝到主节点并添加进authorized_keys

将两个子节点的公钥拷贝到主节点上

分别在两个子节点上执行:

scp /root/.ssh/id_rsa.pub root@Mage1:/root/.ssh/id_rsa_Mage2.pub

scp /root/.ssh/id_rsa.pub root@Mage1:/root/.ssh/id_rsa_Mage3.pub

然后在主节点上,将拷贝过来的两个公钥合并到authorized_keys文件中去

主节点上执行:

cat id_rsa_Mage2.pub>> authorized_keys

cat id_rsa_Mage3.pub>> authorized_keys

将主节点的authorized_keys文件分别替换子节点的authorized_keys文件

主节点上用scp命令将authorized_keys文件拷贝到子节点的相应位置

scp authorized_keys rootMage2:/root/.ssh/

scp authorized_keys rootMage3:/root/.ssh/

最后测试是否配置成功

在Mage1上分别执行

ssh Mage2

ssh Mage3

能正确跳转到两台子节点的操作界面即可,同样在每个子节点通过相同的方式登录主节点和其他子节点也能无密码正常登录就表示配置成功。

这里的配置方式可以有多种操作步骤,最终目的是每个节点上的/root/.ssh/authorized_keys文件中都包含所有的节点生成的公钥内容。

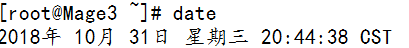

(7)安装jdk(三台机器都要安装)

安装在同一位置**/usl/local/jdk1.8.0_191**

下载JDK : https://www.oracle.com/technetwork/java/javase/downloads/jdk8-downloads-2133151.html

这里推荐一个Windows系统与虚拟机可以相互传输文件的软件FileZilla,下载解压即可用:

链接:https://pan.baidu.com/s/193E3bfbHVpn5lsODg2ijJQ 提取码:kwiw

解压JDK : tar -zxvf /usr/local/jdk-8u73-linux-x64.gz

配置环境变量, 编辑profile文件:

vi /etc/profile

在profile文件末尾添加以下代码:

export JAVA_HOME=/usr/local/jdk1.8.0_191

export JRE_HOME=$JAVA_HOME/jre

export PATH=$JAVA_HOME/bin:$PATH

export CLASSPATH=$JAVA_HOME/lib:$JRE_HOME/lib

保存后,使刚才编辑的文件生效:source /etc/profile

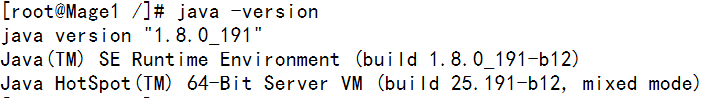

测试是否安装成功:java -version

如下表示jdk环境配置成功:

(8)安装hadoop

安装位置自定,例如安装在/usr/local目录下面

下载hadoop包:

https://www.apache.org/dyn/closer.cgi/hadoop/common/hadoop-2.7.7/hadoop-2.7.7.tar.gz

放在/usr/local目录下,解压hadoop

tar -zxvf hadoop-2.7.7.tar.gz

在usr下面生成hadoop-2.7.7目录

配置环境变量:

vi /etc/profile

在末尾添加:

export HADOOP_HOME=/usr/local/hadoop-2.7.7

export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

保存后使新编辑的profile生效:

source /etc/profile

(9)配置hadoop

配置hadoop配置文件

需要配置的文件的位置为/usr/local/hadoop-2.7.7/etc/hadoop,需要修改的有以下几个文件:

hadoop-env.sh

yarn-env.sh

core-site.xml

hdfs-site.xml

mapred-site.xml

yarn-site.xml

slaves

其中hadoop-env.sh和yarn-env.sh里面都要添加jdk的环境变量

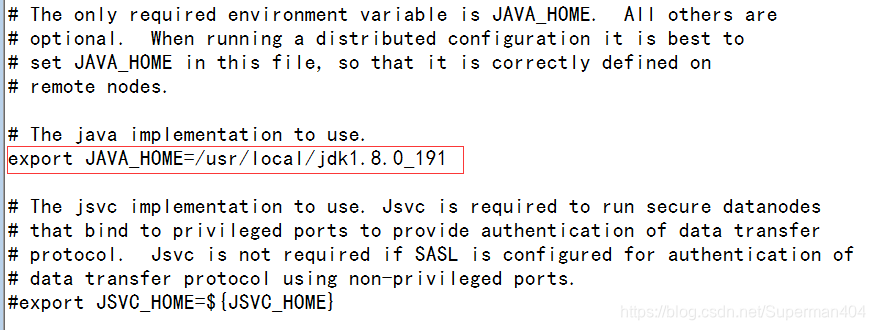

hadoop-env.sh中

添加如下代码:export JAVA_HOME=/usr/local/jdk1.8.0_191 到如下位置:

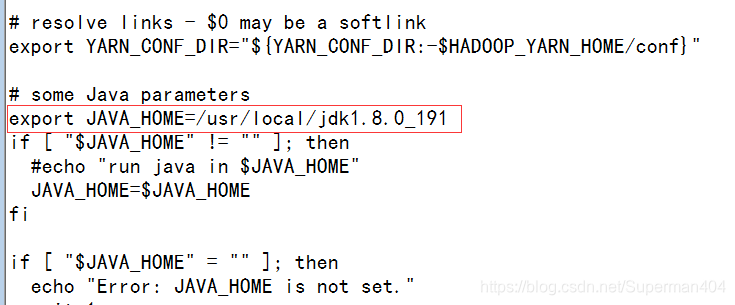

yarn-env.sh中

添加如下代码:export JAVA_HOME=/usr/local/jdk1.8.0_191 到如下位置:

core-site.xml中

添加如下代码:

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://Mage1:9000</value>

</property>

<property>

<name>io.file.buffer.size</name>

<value>131072</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>file:/usr/temp</value>

</property>

<property>

<name>hadoop.proxyuser.root.hosts</name>

<value>*</value>

</property>

<property>

<name>hadoop.proxyuser.root.groups</name>

<value>*</value>

</property>

</configuration>

注:上面代码中file后的路径下的temp文件夹需要自己创建

hdfs-site.xml中

添加如下代码:

<configuration>

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>Mage1:9001</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>file:/usr/dfs/name</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>file:/usr/dfs/data</value>

</property>

<property>

<name>dfs.replication</name>

<value>2</value>

</property>

<property>

<name>dfs.webhdfs.enabled</name>

<value>true</value>

</property>

<property>

<name>dfs.permissions</name>

<value>false</value>

</property>

<property>

<name>dfs.web.ugi</name>

<value>supergroup</value>

</property>

</configuration>

注:上面代码中file后的路径下的/dfs/data文件夹需要自己创建

mapred-site.xml中

(注意要将mapred-site.xml.template重命名为 .xml的文件 Mv mapred-site.xml.template mapred-site.xml)

添加如下代码:

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

<property>

<name>mapreduce.jobhistory.address</name>

<value>Mage1:10020</value>

</property>

<property>

<name>mapreduce.jobhistory.webapp.address</name>

<value>Mage1:19888</value>

</property>

</configuration>

yarn-site.xml中

添加如下代码:

<configuration>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.nodemanager.aux-services.mapreduce.shuffle.class</name>

<value>org.apache.hadoop.mapred.ShuffleHandler</value>

</property>

<property>

<name>yarn.resourcemanager.address</name>

<value>Mage1:8032</value>

</property>

<property>

<name>yarn.resourcemanager.scheduler.address</name>

<value>Mage1:8030</value>

</property>

<property>

<name>yarn.resourcemanager.resource-tracker.address</name>

<value>Mage1:8031</value>

</property>

<property>

<name>yarn.resourcemanager.admin.address</name>

<value>Mage1:8033</value>

</property>

<property>

<name>yarn.resourcemanager.webapp.address</name>

<value>Mage1:8088</value>

</property>

</configuration>

slaves中

修改成:

Mage1

Mage2

拷贝hadoop安装文件到子节点

主节点上执行:

scp -r /usr/hadoop-2.6.4 root@Mage2:/usr

scp -r /usr/hadoop-2.6.4 root@Mage3:/usr

拷贝profile到子节点

主节点上执行:

scp /etc/profile root@Mage2:/etc/

scp /etc/profile root@Mage3:/etc/

在两个子节点上分别使新的profile生效:

source /etc/profile

格式化主节点的namenode

主节点上进入hadoop目录

然后执行:

./bin/hadoop namenode -format

新版本用下面的语句不用hadoop命令了

./bin/hdfs namenode -format

提示:successfully formatted表示格式化成功

启动hadoop

主节点上在hadoop目录下执行:

./sbin/start-all.sh

主节点上jps进程如下:

NameNode

SecondaryNameNode

ResourceManager

每个子节点上的jps进程如下:

DataNode

NodeManager

如果这样表示hadoop集群配置成功