1.基于概率统计的Bayes分类器

因为在实际分类中由于考虑的侧重点不同或者关心的点不一样导致不能使用同一决策去解决所有的事件的分类,所以需要根据不同的准测函数选择不同的分类决策(基于最小错误率的Bayes决策,基于最小风险的Bayes决策)进行分类,在Bayes分类器中将不同的侧重分为错误率和风险俩个方面,最终通过取舍选择不同决策以求达到自己最理想的分类。

即-针对M事件出现可能性而言,不考虑其他任何条件就直接进行事件的分类,所以所提供的信息太少。如:药品公司生产的药,显然一般情况下合格的药品要比不合格的药品的数量所占比例大,所以就容易直接将所有药品都归类为合格的药品,这样并不能很好的将合格和不合格的药品进行分类。

指-已知某类别的特征空间中出现特征X的概率密度,即第w类样品中它的属性X是如何分布的。(在大多数情况下,类条件概率密度函数可以采用多维变量的正太概率密度函数来模拟)。

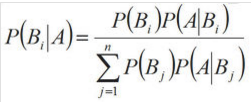

即-可能出现多类别事件出现同一特征的情况,这时就需要判断在条件X出现的条件下,样品为w的概率是多少,而这个后验概率就是使用Bayes公式计算获得的。公式如下:

其中P(Bi)和P(Bj)是指事件Bi和Bj的先验概率,即P(Bi)=Bi/B,P(Bj)=Bj/B;P(A|Bi)和P(A|Bj)是类条件概率密度,指在类Bi和Bj的特征空间中,出现特征A的概率。

使用此种分类器必须要知道有关样品的总体分布知识,包括各类的先验概率、类条件概率密度函数、后验概率,并以这些作为产生判别函数的依据,设计出相应的判别函数与决策面,这种方法称为参数判别式方法。这样,一旦待测试分类样品的特征向量值X已知,就可以确定X对各类的后验概率,也就可以按照相应的准则计算与分类。所以这种分类方法只能用在有统计知识的场合,或能利用训练样品估计出参数的场合。

2.几何分类器

集合分类器不依赖于条件概率的知识,可以理解为通过几何的方法,把特征空间分解为对应于不同类别的子空间。几何分类方法按照分界函数的形式可以分为线性判别函数和非线性判别函数俩类。而在几何分类方法中比较常见的算法有感知器算法、增量校正算法、LMSE分类算法以及Fisher分类算法,这里重点说一下Fisher分类算法。

在应用统计方法解决模式识别问题时,经常会遇到所谓的“维数灾难”的问题,在低维空间里适用的方法一旦换成高维往往就不合适了。因此压缩特征空间的维数就显得非常重要,感觉有点像PCA但二者又有很大的区别,只是降维的思想一致而已。Fisher的核心是将原始数据投影到一维空间中,使得原本线性不可分的数据变得线性可分。Fisher的关键在于最大化一个准则函数J,准则函数J是由类间散度比上类内散度得到的。最大化准则函数J是要求类内散度足够小而类间散度足够大。小的类内散度保证了当前类中的数据足够紧密。大的类间散度保证了这两个类有足够的可分性。类间散度定义为投影后两类样本均值差的平方。类内散度定义为两类样本投影后与各自均值差的和的平方和。

从图中可以看出在将空间中的数据进行一维投影时很有可能造成数据重叠,这样会直接影响到实际的分类效果,所以在投影前需要找到最佳的投影向量(这也就是为什么Fisher的准则函数要求数据的类内聚,类与类间松散的原因),而投影后还需要找到类与类之间的划分边界点,只有完美的找到这两个量才能很好的对数据进行分类。

1.求取俩类的均值向量

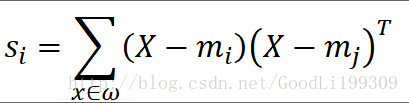

2.求取俩类的内离散度矩阵Si、Sj

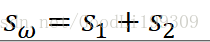

3.求取总类间离散度矩阵Sw

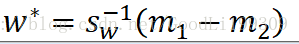

4.定义Fisher准则函数w*(增大类内聚和类间松散)

5.对于俩类已知数据,求出它们在w*上的投影点D

6.求取各类数据在投影空间上的均值A

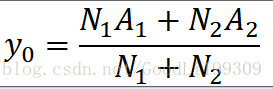

7.选取阈值y0(在投影空间中的分割阈值)

8.计算未知样品X在w*上的投影点并根据决策进行分类

3.神经网络分类器

人工神经网络(Artificial Neural Networks,ANN),简称为神经网络(NN),它是一种基于连接学说构造的智能仿生模型,是由大量神经元组成的非线性动力系统。对于神经网络,我自己的理解就是通过研究、分析、总结人脑的组织结构和活动规律,对这些发现进行抽象、简化,从而模仿人脑建立的一种模型。

它根据神经元之间连接的拓扑结构上的不同分为分层网络和互相连接型网络。分层网络是将网络中的所有神经元按功能分为若干层,一般有输入层、中间层和输出层,各层间顺序连接,代表有BP网络。相互连接型网络是指网络中任意俩个单元之间可以相互连接。

模仿人的学习方式,在神经网络中有三种学习方式,分别是:有导师学习网络、无导师学习网络和强化学习网络,其中有导师学习网络通常称为有监督型学习,而无导师学习网络称为无监督学习。

可以看成是从输入空间到输出空间的一个非线性映射,其通过调整权重和阈值来“学习”或发现变量间的关系,实现对事物的认识和分类。

1.固有的并行结构和并行处理

在同一层内的处理单元都是同时操作的,即神经网络的计算功能分布在多个处理单元上。

2.知识的分布存储

知识不是存储在特定的存储单元上,而是分布在整个系统中,要存储多个知识就需要很多连接。在计算机中,只要给定一个地址就可得到一个或一组数据。在神经网络中要获得存储的知识则采用“联想”的办法。

3.容错性

具有很强的容错性,其可以从不完善的数据和图形进行学习和做决定。因为知识是存储在整个网络系统中的,而不是存储在某个存储单元,所以预定比例的节点不参与运算对整个系统的性能不会产生重大的影响。它可以处理那些有噪声和不完整的数据,具有泛化功能和很强的容错能力。

4.自适应性

其是通过学习和训练来找出输入和输出之间的内在联系,从而求取问题的解,所以有自适应功能对结果进行不断的调整,最终获得最优解。

5.模式识别能力

神经网络对处理复杂的非线性关系有很大的先天优势。

4.聚类

这是一种无监督的分类方法,是根据提取、分析n维空间中的数据的特征,将具有相似类型的数据聚合成一类,通常被称为聚类或集群。

聚类分析的结果可以被用来对数据提出初始假设,分类新数据,测试数据的同类型以及压缩数据。如通过聚类将一个图像进行分割(分割就是把图像分割成若干有意义的区域的处理技术,这些区域互不交叠,每个区域内部的某种特性或相同或相近,而不同区域间有明显差异)。

一般有俩种方法来最为聚类优劣的准则,一是经验(如:以距离函数作为相似度的度量,用不断修改的阈值,来探究聚类效果的满意程度);二是准则函数,其函数值与数据的划分有关,当取得极小值时就认为得到了最佳划分。

在所有的事物中并不是所有的都是精确的,都可以分个是非曲折或者将某些数据精确的划分为不同的分类,既然存在确定的那必然也存在不确定的,即模糊的。在实际生活中,我们人往往对那些模糊的事物也不能进行很好的判断,大多通过分析、理解、推理、总结对那些模棱两可的进行经验性的分类。即使这样,对于不同的人看待的不同的事物仍然是不能进行统一的,如人的高矮,胖瘦以及哪个年龄属于中年阶段等等,但是对于这些又大概可以划分出一个多数人比较认可的范围,我们可以把这个范围视为模糊集。在模糊聚类中正是通过对这些模糊集进行运算、分析来对模糊数据进行分类的(比较常用的是模糊矩阵)。