接着k8s安装篇②操作

在Node节点部署组件

Master apiserver启用TLS认证后,Node节点kubelet组件想要加入集群,必须使用CA签发的有效证书才能与apiserver通信,当Node节点很多时,签署证书是一件很繁琐的事情,因此有了TLS Bootstrapping机制,kubelet会以一个低权限用户自动向apiserver申请证书,kubelet的证书由apiserver动态签署。

认证大致工作流程如图所示:

下面这些操作在master节点完成

将kubelet-bootstrap用户绑定到系统集群角色

[root@k8s-master1 ~]# /opt/kubernetes/bin/kubectl create clusterrolebinding kubelet-bootstrap \

--clusterrole=system:node-bootstrapper \

--user=kubelet-bootstrap

返回值

#clusterrolebinding.rbac.authorization.k8s.io/kubelet-bootstrap created #不复制

创建kubeconfig文件:

在生成kubernetes证书的目录下执行以下命令生成kubeconfig文件:

[root@k8s-master1 ~]# cd /opt/crt/

指定apiserver 内网负载均衡地址

下面重点讲一下,做下面操作的时候,千万不要断开网线,一直做完即可

[root@k8s-master1 crt]# KUBE_APISERVER="https://192.168.246.162:6443" #写你master的ip地址,集群中就写负载均衡的ip地址

第二步

[root@k8s-master1 crt]# BOOTSTRAP_TOKEN=674c457d4dcf2eefe4920d7dbb6b0ddc

设置集群参数

[root@k8s-master1 crt]# /opt/kubernetes/bin/kubectl config set-cluster kubernetes \

--certificate-authority=ca.pem \

--embed-certs=true \

--server=${KUBE_APISERVER} \

--kubeconfig=bootstrap.kubeconfig

设置客户端认证参数

[root@k8s-master crt]# /opt/kubernetes/bin/kubectl config set-credentials kubelet-bootstrap \

--token=${BOOTSTRAP_TOKEN} \

--kubeconfig=bootstrap.kubeconfig

设置上下文参数

[root@k8s-master crt]# /opt/kubernetes/bin/kubectl config set-context default \

--cluster=kubernetes \

--user=kubelet-bootstrap \

--kubeconfig=bootstrap.kubeconfig

设置默认上下文

[root@k8s-master crt]# /opt/kubernetes/bin/kubectl config use-context default --kubeconfig=bootstrap.kubeconfig

进行创建第二个文件

创建kube-proxy kubeconfig文件

[root@k8s-master1 crt]# /opt/kubernetes/bin/kubectl config set-cluster kubernetes \

--certificate-authority=ca.pem \

--embed-certs=true \

--server=${KUBE_APISERVER} \

--kubeconfig=kube-proxy.kubeconfig

第二步

[root@k8s-master1 crt]# /opt/kubernetes/bin/kubectl config set-credentials kube-proxy \

--client-certificate=kube-proxy.pem \

--client-key=kube-proxy-key.pem \

--embed-certs=true \

--kubeconfig=kube-proxy.kubeconfig

第三步

[root@k8s-master1 crt]# /opt/kubernetes/bin/kubectl config set-context default \

--cluster=kubernetes \

--user=kube-proxy \

--kubeconfig=kube-proxy.kubeconfig

第四步

[root@k8s-master1 crt]# /opt/kubernetes/bin/kubectl config use-context default --kubeconfig=kube-proxy.kubeconfig

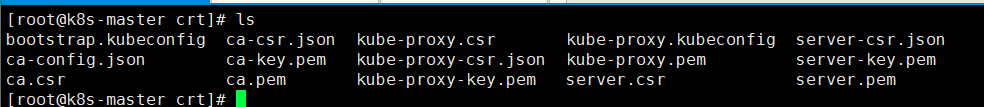

查看一下,会生成俩个证书

[root@k8s-master1 crt]# ls

bootstrap.kubeconfig kube-proxy.kubeconfig

#必看:将这两个文件拷贝到Node节点/opt/kubernetes/cfg目录下

#必看:将这两个文件拷贝到Node节点/opt/kubernetes/cfg目录下

[root@k8s-master1 crt]# scp *.kubeconfig k8s-node1:/opt/kubernetes/cfg/

[root@k8s-master1 crt]# scp *.kubeconfig k8s-node2:/opt/kubernetes/cfg/

这里讲一下,要去node1 node2 节点上面去查看一下

下面这些操作在node节点完成

部署kubelet组件

#将前面下载的二进制包中的kubelet和kube-proxy拷贝到/opt/kubernetes/bin目录下,我们master主节点上面,直接上传的安装包,把安装包可以拷贝过去。

将master上面的包拷贝过去

[root@k8s-master1 ~]# scp kubernetes-server-linux-amd64.tar.gz k8s-node1:/root/

[root@k8s-master1 ~]# scp kubernetes-server-linux-amd64.tar.gz k8s-node2:/root/

解压 进入解压的目录下面

[root@k8s-node1 ~]# tar xzf kubernetes-server-linux-amd64.tar.gz

[root@k8s-node1 ~]# cd kubernetes/server/bin/

拷贝一下文件

[root@k8s-node1 bin]# cp kubelet kube-proxy /opt/kubernetes/bin/

在两个node节点创建kubelet配置文件:重点俩个节点都操作

[root@k8s-node1 ~]# vim /opt/kubernetes/cfg/kubelet

下面文件,记得修改成自己的ip ,不要有空格,中文

KUBELET_OPTS="--logtostderr=true \

--v=4 \

--hostname-override=192.168.246.164 \ #每个节点自己的ip地址

--kubeconfig=/opt/kubernetes/cfg/kubelet.kubeconfig \

--bootstrap-kubeconfig=/opt/kubernetes/cfg/bootstrap.kubeconfig \

--config=/opt/kubernetes/cfg/kubelet.config \

--cert-dir=/opt/kubernetes/ssl \

--pod-infra-container-image=registry.cn-hangzhou.aliyuncs.com/google-containers/pause-amd64:3.0" #这个镜像需要提前下载

俩个节点上面拉取镜像

[root@k8s-node1 ~]# docker pull registry.cn-hangzhou.aliyuncs.com/google-containers/pause-amd64:3.0

[root@k8s-node2 ~]# docker pull registry.cn-hangzhou.aliyuncs.com/google-containers/pause-amd64:3.0

参数说明:

* --hostname-override 在集群中显示的主机名

* --kubeconfig 指定kubeconfig文件位置,会自动生成

* --bootstrap-kubeconfig 指定刚才生成的bootstrap.kubeconfig文件

* --cert-dir 颁发证书存放位置

* --pod-infra-container-image 管理Pod网络的镜像

其中/opt/kubernetes/cfg/kubelet.config配置文件如下:

[root@k8s-node1 ~]# vim /opt/kubernetes/cfg/kubelet.config

下面文件,记得修改成自己的ip ,不要有空格,中文

kind: KubeletConfiguration

apiVersion: kubelet.config.k8s.io/v1beta1

address: 192.168.246.164 #写你机器的ip地址

port: 10250

readOnlyPort: 10255

cgroupDriver: cgroupfs

clusterDNS: ["10.0.0.2"] #不要改,就是这个ip地址

clusterDomain: cluster.local.

failSwapOn: false

authentication:

anonymous:

enabled: true

webhook:

enabled: false

systemd管理kubelet组件:

# vim /usr/lib/systemd/system/kubelet.service

下面文件不用修改 直接复制

[Unit]

Description=Kubernetes Kubelet

After=docker.service

Requires=docker.service

[Service]

EnvironmentFile=/opt/kubernetes/cfg/kubelet

ExecStart=/opt/kubernetes/bin/kubelet $KUBELET_OPTS

Restart=on-failure

KillMode=process

[Install]

WantedBy=multi-user.target

启动:

# systemctl daemon-reload

# systemctl enable kubelet

# systemctl start kubelet

# systemctl status kubelet

来到master节点上面查看一下,

来到master节点上面查看一下,

[root@k8s-master ~]# /opt/kubernetes/bin/kubectl get csr

NAME AGE REQUESTOR CONDITION

node-csr-F5AQ8SeoyloVrjPuzSbzJnFKQaUsier7EGvNFXLKTqM 17s kubelet-bootstrap Pending

node-csr-bjeHSWXOuUDSHganJPL_hDz_8jjYhM2FQyTkbA9pM0Q 18s kubelet-bootstrap Pending

在Master审批Node加入集群:

启动后还没加入到集群中,需要手动允许该节点才可以。在Master节点查看请求签名的Node:

[root@k8s-master1 ~]# /opt/kubernetes/bin/kubectl certificate approve XXXXID

注意:xxxid 指的是上面的NAME这一列

[root@k8s-master1 ~]# /opt/kubernetes/bin/kubectl get csr

NAME AGE REQUESTOR CONDITION

node-csr--1TVDzcozo7NoOD3WS2t9xLQqNunsVXj_i2AQ5x1mbs 1m kubelet-bootstrap Approved,Issued

node-csr-L0wqvr69oy8rzXwFm1u1uNx4aEMOOvd_RWPxaAERn_w 27m kubelet-bootstrap Approved,Issued

配置完是上面的

查看集群节点信息:

查看集群节点信息:

[root@k8s-master1 ~]# /opt/kubernetes/bin/kubectl get node

NAME STATUS ROLES AGE VERSION

192.168.246.164 Ready <none> 1m v1.11.10

192.168.246.165 Ready <none> 17s v1.11.10

部署kube-proxy组件

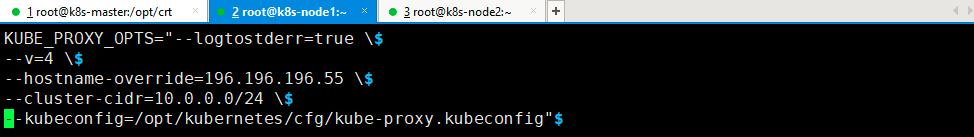

创建kube-proxy配置文件:还是在所有node节点,重点俩个上面都操作

[root@k8s-node1 ~]# vim /opt/kubernetes/cfg/kube-proxy

# cat /opt/kubernetes/cfg/kube-proxy

下面文件,记得修改成自己的ip ,不要有空格,中文

KUBE_PROXY_OPTS="--logtostderr=true \

--v=4 \

--hostname-override=192.168.246.164 \ #写每个node节点ip

--cluster-cidr=10.0.0.0/24 \ //不要改,就是这个ip

--kubeconfig=/opt/kubernetes/cfg/kube-proxy.kubeconfig"

systemd管理kube-proxy组件:

[root@k8s-node1 ~]# cd /usr/lib/systemd/system

# cat /usr/lib/systemd/system/kube-proxy.service

一下文件不用修改,直接复制即可

[Unit]

Description=Kubernetes Proxy

After=network.target

[Service]

EnvironmentFile=-/opt/kubernetes/cfg/kube-proxy

ExecStart=/opt/kubernetes/bin/kube-proxy $KUBE_PROXY_OPTS

Restart=on-failure

[Install]

WantedBy=multi-user.target

启动:

# systemctl daemon-reload

# systemctl enable kube-proxy

# systemctl start kube-proxy

# systemctl status kube-proxy

在master查看集群状态

在master查看集群状态

[root@k8s-master1 ~]# /opt/kubernetes/bin/kubectl get node

NAME STATUS ROLES AGE VERSION

192.168.246.164 Ready <none> 19m v1.11.10

192.168.246.165 Ready <none> 18m v1.11.10

查看集群状态

[root@k8s-master1 ~]# /opt/kubernetes/bin/kubectl get cs

NAME STATUS MESSAGE ERROR

scheduler Healthy ok

controller-manager Healthy ok

etcd-0 Healthy {"health": "true"}

etcd-1 Healthy {"health": "true"}

etcd-2 Healthy {"health": "true"}

测试,我们去运行一个nginx容器

运行一个测试示例–在master节点先安装docker服务

创建一个Nginx Web,判断集群是否正常工 master节点上面

/opt/kubernetes/bin/kubectl run nginx --image=daocloud.io/nginx --replicas=3

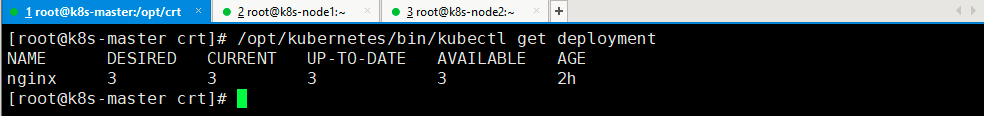

在master上面查看

查看资源对象

/opt/kubernetes/bin/kubectl get deployment

有三个容器 三个副本说明没有问题

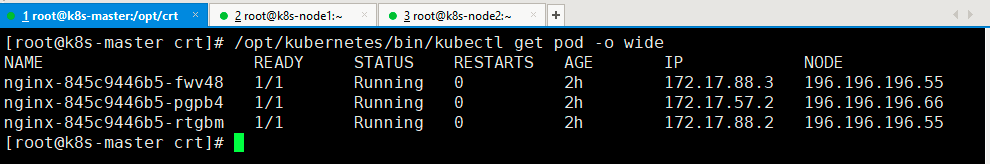

查看一下,每个容器的ip

查看一下,每个容器的ip

/opt/kubernetes/bin/kubectl get pod -o wide

测试一下能不能ping通,我们在node节点上面测试 ,因为我们的从节点上面安装拉了,Flannel网络**

测试一下能不能ping通,我们在node节点上面测试 ,因为我们的从节点上面安装拉了,Flannel网络**

ping 172.17.88.3

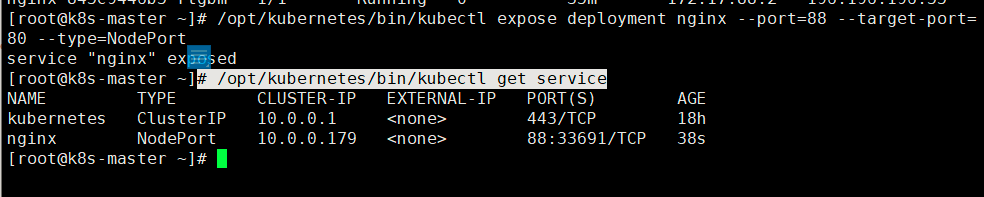

暴露在外网

/opt/kubernetes/bin/kubectl expose deployment nginx --port=88 --target-port=80 --type=NodePort

查看容器的端口

/opt/kubernetes/bin/kubectl get service

访问nodeip加端口

访问nodeip加端口

打开浏览器输入:http://196.196.196.55:33691

恭喜你,集群部署成功!

部署Dashboard(Web UI) 可选项目

* dashboard-deployment.yaml #部署Pod,提供Web服务

* dashboard-rbac.yaml #授权访问apiserver获取信息

* dashboard-service.yaml #发布服务,提供对外访问

创建一个目录 master节点

[root@k8s-master ~]# mkdir webui

[root@k8s-master ~]# cd webui/

[root@k8s-master webui]# vim dashboard-deployment.yaml

[root@k8s-master webui]# cat dashboard-deployment.yaml

下面文件不用修改,直接复制即可

apiVersion: apps/v1beta2

kind: Deployment

metadata:

name: kubernetes-dashboard

namespace: kube-system

labels:

k8s-app: kubernetes-dashboard

kubernetes.io/cluster-service: "true"

addonmanager.kubernetes.io/mode: Reconcile

spec:

selector:

matchLabels:

k8s-app: kubernetes-dashboard

template:

metadata:

labels:

k8s-app: kubernetes-dashboard

annotations:

scheduler.alpha.kubernetes.io/critical-pod: ''

spec:

serviceAccountName: kubernetes-dashboard

containers:

- name: kubernetes-dashboard

image: registry.cn-hangzhou.aliyuncs.com/kube_containers/kubernetes-dashboard-amd64:v1.8.1

resources:

limits:

cpu: 100m

memory: 300Mi

requests:

cpu: 100m

memory: 100Mi

ports:

- containerPort: 9090

protocol: TCP

livenessProbe:

httpGet:

scheme: HTTP

path: /

port: 9090

initialDelaySeconds: 30

timeoutSeconds: 30

tolerations:

- key: "CriticalAddonsOnly"

operator: "Exists"

第二个文件

[root@k8s-master webui]# vim dashboard-rbac.yaml

[root@k8s-master webui]# cat dashboard-rbac.yaml

下面不用修改,直接复制即可

apiVersion: v1

kind: ServiceAccount

metadata:

labels:

k8s-app: kubernetes-dashboard

addonmanager.kubernetes.io/mode: Reconcile

name: kubernetes-dashboard

namespace: kube-system

---

kind: ClusterRoleBinding

apiVersion: rbac.authorization.k8s.io/v1beta1

metadata:

name: kubernetes-dashboard-minimal

namespace: kube-system

labels:

k8s-app: kubernetes-dashboard

addonmanager.kubernetes.io/mode: Reconcile

roleRef:

apiGroup: rbac.authorization.k8s.io

kind: ClusterRole

name: cluster-admin

subjects:

- kind: ServiceAccount

name: kubernetes-dashboard

namespace: kube-system

第三个文件

[root@k8s-master webui]# vim dashboard-service.yaml

[root@k8s-master webui]# cat dashboard-service.yaml

下面文件直接复制即可,不用修改

apiVersion: v1

kind: Service

metadata:

name: kubernetes-dashboard

namespace: kube-system

labels:

k8s-app: kubernetes-dashboard

kubernetes.io/cluster-service: "true"

addonmanager.kubernetes.io/mode: Reconcile

spec:

type: NodePort

selector:

k8s-app: kubernetes-dashboard

ports:

- port: 80

targetPort: 9090

创建一个容器运行

[root@k8s-master webui]# /opt/kubernetes/bin/kubectl create -f dashboard-rbac.yaml

[root@k8s-master webui]# /opt/kubernetes/bin/kubectl create -f dashboard-deployment.yaml

[root@k8s-master webui]# /opt/kubernetes/bin/kubectl create -f dashboard-service.yaml

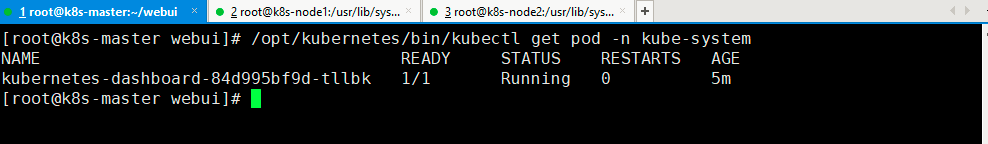

等待数分钟,查看资源状态:

/opt/kubernetes/bin/kubectl get pod -n kube-system

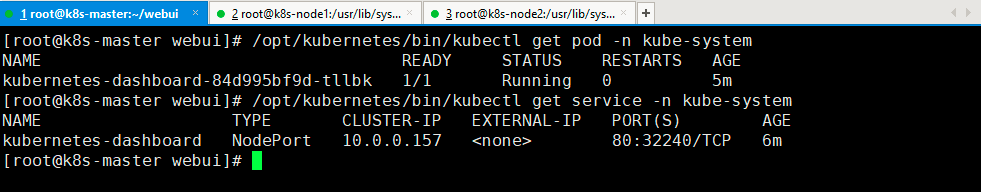

查看 ui网页的IP

查看 ui网页的IP

/opt/kubernetes/bin/kubectl get service -n kube-system

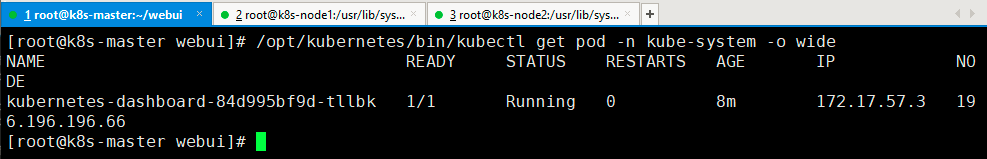

查看这个容器运行在那台节点上面

/opt/kubernetes/bin/kubectl get pod -n kube-system -o wide

访问?http://196.196.196.66:32240

部署成功,大功告成