一、操作步骤

只记录过程,不讲述原理

1.获取用户ID和cookie

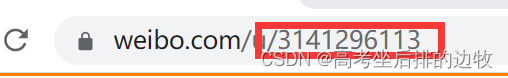

用户ID在进入个人主页时导航栏中就会有显示,例如下面这样:

cookie获取(有的代码无需cookie也能运行):

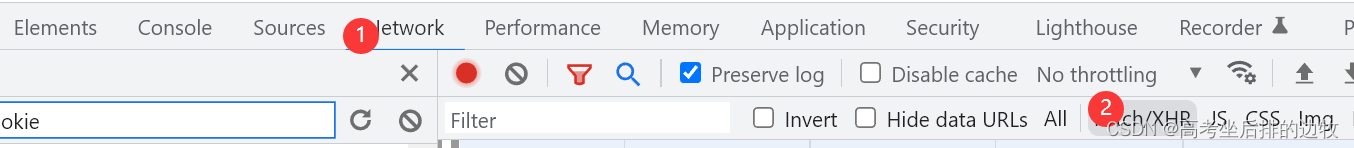

微博登陆后,进入个人主页,打开开发者工具,点击network和Fetch/XHR:

可以尝试点击“weibo”:

此时可以看到出现

此时可以看到出现myblog开头数据包:

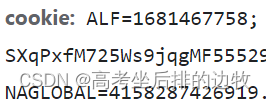

点击该数据包,点击"Headers",下翻,可以看到其“Header Request”中就有cookie,复制即可:

2.程序下载(也就是二、中的项目)

(1)下载git,然后在希望安装爬虫项目的文件目录下打开git bash(或克隆项目时指定文件位置),输入以下命令:

git clone https://github.com/dataabc/weibo-crawler.git

3.程序运行

(1)首先对config文件中的参数进行修改,改成自己需要的,包括ID,cookie,是否下载图片等,具体参数作者在README中写得很清楚。

(2)安装依赖,可能会有版本冲突报错,按提示该升级升级就行:

pip install -r requirements.txt

(3)运行就直接在git bash中输入:

python weibo.py

(4)时间可能较长,运行完毕后出现weibo文件夹,数据都存在里面

二、完整代码网址

https://github.com/dataabc/weibo-crawler

参考并感谢:

https://www.cnblogs.com/wangzheming35/

@misc{weibospider2020,

author = {Lei Chen, Zhengyang Song, schaepher, minami9, bluerthanever, MKSP2015, moqimoqidea, windlively, eggachecat, mtuwei, codermino, duangan1},

title = {{Weibo Spider}},

howpublished = {\url{https://github.com/dataabc/weiboSpider}},

year = {2020}

}

本文内容由网友自发贡献,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系:hwhale#tublm.com(使用前将#替换为@)