导言

语言模型在人工智能领域中扮演着重要的角色,它不仅是自然语言处理的基础,也是许多智能系统的核心。本文将深入研究语言模型的原理、广泛应用以及未来发展趋势。

1. 语言模型的原理

-

统计语言模型:

基于概率统计的传统语言模型,如N-gram模型。

-

神经网络语言模型:

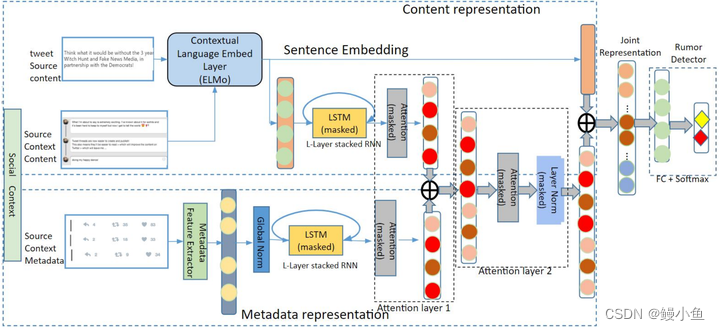

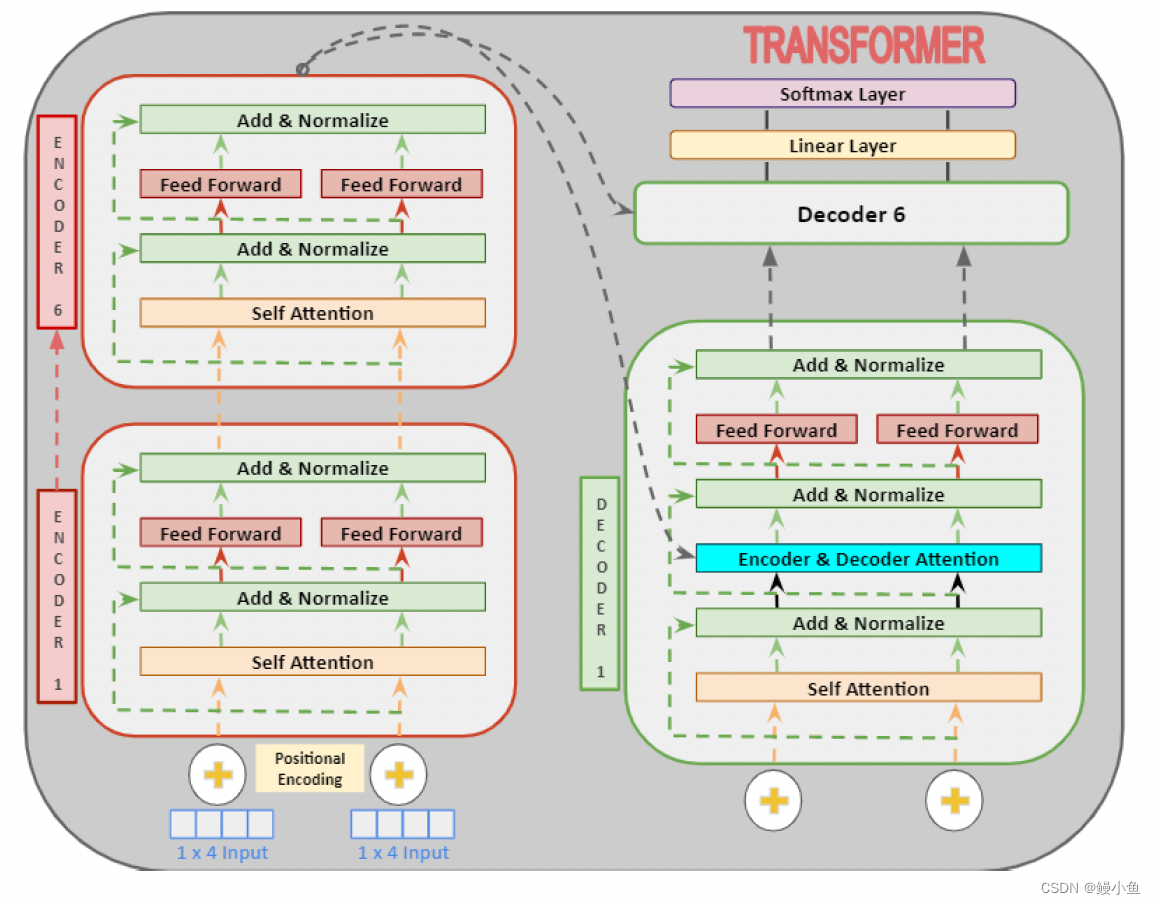

利用深度学习技术,如循环神经网络(RNN)、长短时记忆网络(LSTM)、和最新的Transformer模型。

2. 应用领域及典型案例

-

自然语言处理:

语言模型在文本生成、情感分析、机器翻译等任务中发挥关键作用。

-

虚拟助手:

Siri、Alexa、Google Assistant等语音助手通过语言模型实现语音理解和交互。

-

智能写作:

语言模型用于辅助创作、自动摘要和文章生成。

3. 技术挑战

-

长距离依赖:

传统语言模型在处理长距离依赖关系时可能面临困难。

-

多模态融合:

如何将语言模型与视觉、声音等多模态信息有机融合,提升综合理解能力。

-

可解释性:

对于深度学习模型,如何提高语言模型的可解释性,增加用户信任。

4. 创新技术与发展趋势

-

预训练模型:

BERT、GPT系列等预训练语言模型通过大规模语料的预训练,取得了在多个任务上的显著性能提升。

-

零样本学习:

探索语言模型在少量或零样本学习上的能力,使其更具通用性。

-

语境感知:

模型对上下文更敏感,理解语境中的复杂信息。

5. 伦理和社会影响

-

偏见问题:

语言模型在处理大规模数据时可能学到社会偏见,引发公平性和偏见问题。

-

隐私:

处理个人信息时,如何平衡语言模型的功能与用户隐私的保护。

6. 未来展望

语言模型将持续在自然语言处理、智能对话、智能写作等领域发挥关键作用,预计未来会出现更加强大和智能的语言模型。

延伸阅读

语言模型与大语言模型:联系与区别

1.

联系

:

语言模型:

语言模型是一种用于建模语言结构的系统,旨在理解并生成符合语法和语义规则的文本。传统的语言模型主要采用统计方法,例如N-gram模型,而近年来,基于深度学习的神经网络语言模型也得到了广泛应用。

大语言模型:

大语言模型通常是指具有大规模参数和训练数据的语言模型,以提高对复杂语言结构的建模能力。这些模型常常采用深度学习技术,如Transformer架构,并通过大规模预训练使模型具备强大的语言理解和生成能力。

2.

区别

:

规模和参数:

大语言模型的主要特点在于规模庞大,参数众多。这使得大语言模型能够学习到更复杂、更深层次的语言表示,对上下文的理解更为精准。

预训练和微调:

大语言模型通常通过在大规模数据上进行预训练,学习通用的语言表示。随后,可以通过在特定任务上进行微调,使模型适应具体应用领域,例如文本分类、语义理解等。

应用范围:

一般的语言模型可能主要用于简单的任务,如语言生成或基本的文本分类。而大语言模型由于其强大的表示能力,可在更广泛的任务中取得良好效果,包括问答系统、机器翻译、摘要生成等。

社会关切:

大语言模型引发了对隐私、伦理以及潜在滥用的担忧。这是因为这些模型可以生成高度真实的文本,可能被滥用用于虚假信息、网络欺诈等活动。

发展趋势:

随着技术的不断进步,大语言模型的发展趋势包括对更大规模的数据集和更复杂的模型结构的探索,以及解决模型的可解释性和公平性等方面的挑战。

完结撒花

语言模型作为人工智能的核心组成部分,不仅推动了自然语言处理的发展,也在智能系统中发挥越来越重要的作用,为人机交互提供了更加智能、自然的体验。

总体而言,大语言模型可以视为语言模型的一种演化形式,其更大的规模和强大的学习能力使其在自然语言处理领域的应用得到了显著提升。