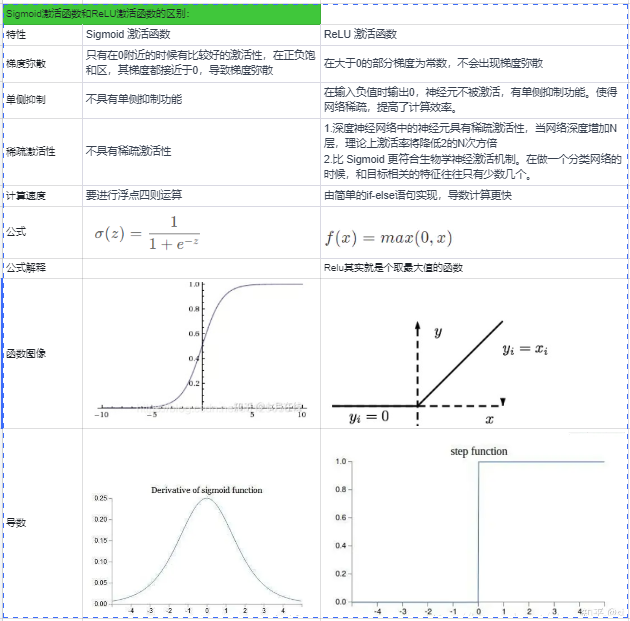

| Sigmoid激活函数和ReLU激活函数的区别: |

|

| 特性 |

Sigmoid 激活函数 |

ReLU 激活函数 |

| 梯度弥散 |

只有在0附近的时候有比较好的激活性,在正负饱和区,其梯度都接近于0,导致梯度弥散

|

在大于0的部分梯度为常数,不会出现梯度弥散 |

| 单侧抑制 |

不具有单侧抑制功能 |

在输入负值时输出0,神经元不被激活,有单侧抑制功能。使得网络稀疏,提高了计算效率。 |

| 稀疏激活性 |

不具有稀疏激活性 |

1.深度神经网络中的神经元具有稀疏激活性,当网络深度增加N层,理论上激活率将降低2的N次方倍

2.比 Sigmoid 更符合生物学神经激活机制。在做一个分类网络的时候,和目标相关的特征往往只有少数几个。 |

| 计算速度 |

要进行浮点四则运算 |

由简单的if-else语句实现,导数计算更快 |

| 公式 |

|

|

| 公式解释 |

|

Relu其实就是个取最大值的函数 |

| 函数图像 |

|

|

| 导数 |

|

|

本文内容由网友自发贡献,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系:hwhale#tublm.com(使用前将#替换为@)