目录

一、环境配置

二、eclipse环境设置

三、代码编写

1.引入库

2.Test

3.成功界面

总结

一、环境配置

准备文件:jar包和Windows版本的hadoop2.7.4

复制:Windows版本的hadoop2.7.4文件中的bin目录下的hadoop.dll

复制:Windows版本的hadoop2.7.4文件中的bin目录下的hadoop.dll 到 C:\Windows\System32目录下

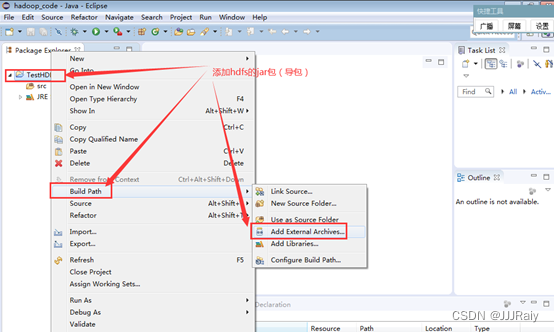

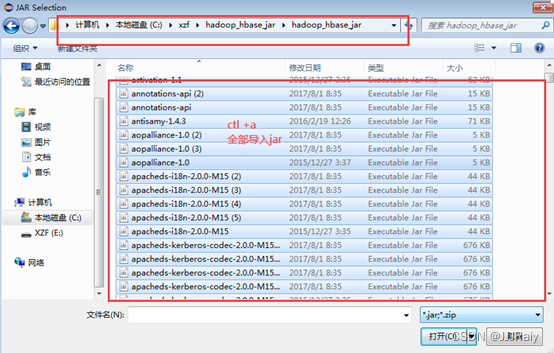

二、eclipse环境设置

添加.jar包

三、代码编写

1.引入库

FileSystem fs = null;

@Before

public void init() throws IOException

{ //上传环境,设置hadoop2.7.4所在路径

System.setProperty("hadoop.home.dir", "D:\\hadoop-2.7.4\\hadoop274");

System.setProperty("HADOOP_USER_NAME","root"); //获得权限

Configuration conf = new Configuration();

conf.set("fs.defaultFS", "hdfs://IP:9000"); //访问网址

fs = FileSystem.get(conf);

}

2.Test

@Test

public void upLoadFile() throws IOException //上传

{

Path src = new Path("D:/xxx.txt");

Path dst = new Path("/");

fs.copyFromLocalFile(src, dst);

fs.close();

}

@Test

public void DownLoadFile() throws IOException //下载

{

Path src = new Path("/xxx.txt"); //路径设置

Path dst = new Path("D:/");

fs.copyToLocalFile(src, dst);

fs.close(); //关闭资源

}

@Test

public void testMkdir() throws IllegalAddException,IOException

{

fs.mkdirs(new Path("/"));//创建

fs.mkdirs(new Path("/"))

fs.delete(new Path("/"),true); //删除

}

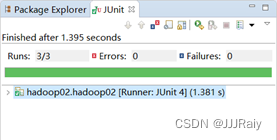

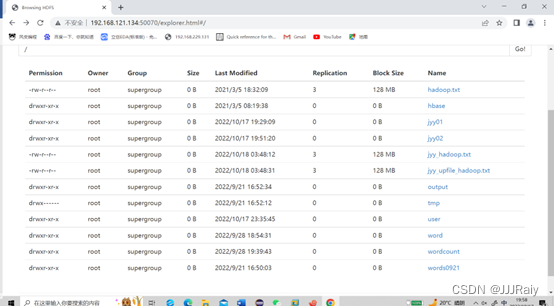

3.成功界面

1.eclipse界面

2.IP地址:50070界面

总结

1. 如果程序运行有错,大概率是方法名错误,路径错误

2.IP地址一点要正确!!!

3.有时候copyFromLocalFile(src, dst)方法会出错,大多数情况下是默认,若出错需改成copyFromLocalFile(false,src, dst,true),原因是与windows不兼容

4.若在环境中配置了Hadoop权限记得更改

System.setProperty("HADOOP_USER_NAME","root"); //获得权限

5.可在虚拟机挂起后,在Xshell,start-all.sh,在Google中输入 IP地址:50070(冒号记得是英文字符,不用在IP地址前加http:/),查看是否上传,下载,删除