线性回归

我们的回归方程常写成如下形式:

hθ(x)=θ0+θ1*X

代价函数:J(θ)=12∑i=1m(hθ(x(i)−y(i))2

看看代价函数到底是在干什么,如图

梯度下降是一个用来求函数最小值的算法,我们将使用梯度下降算法来求代价函数最小

例如:想象一下你正站立在山的这一点上,站立在你想象的公园这座红色山上,在梯度下降算法中,我们要做的就是旋转 360 度,看看我们的周围,并问自己要在某个方向上,用小碎步尽快下山。这些小碎步需要朝什么方向?如果我们站在山坡上的这一点,你看一下周围,你会发现最佳的下山方向,重复上面的步骤,从这个新的点,你环顾四周,并决定从什么方向将会最快下山,然后又迈进了一小步,并依此类推,直到你接近局部最低点的位置。

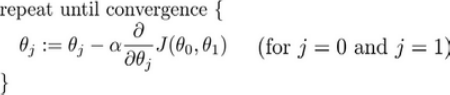

批量梯度下降算法的公式为:

其中是α学习率,它决定了我们沿着能让代价函数下降程度最大的方向

向下迈出的步子有多大,在批量梯度下降中,我们每一次都同时让所有的参数减去学习速率乘以代价函数的导数。

下面这两种情况都是α值(学习率)较大,应减小α值,通常可以考虑尝试些学习率:

本文内容由网友自发贡献,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系:hwhale#tublm.com(使用前将#替换为@)