ERNIE: Enhanced Representation through Knowledge Integration

Created time: July 26, 2021 1:50 PM

Last edited time: July 30, 2021 9:24 AM

PDF: https://arxiv.org/pdf/1904.09223v1.pdf

Tags: Bert

参考材料: https://blog.csdn.net/weixin_41089007/article/details/103642082

大致思路: 整合先验知识【知识增强的手段】进行优化,mask的时候进行短语以及实体级别的mask

精读: Yes

编辑人: Freax Ruby

目录

概述

整合先验知识【知识增强的手段】进行优化,mask的时候进行短语以及实体级别的mask

之前有哪些方法

- 采用矢量表示单词 ,上下文无关的表示

- 采用上下文来预测丢失的单词【没有考虑先验知识】

- Skip-thought

- 提出了一种通用的分布式句子编码器的无监督学习方法。

- Cove

- 表明,与在各种常见的NLP任务上仅使用无监督的单词和字符向量相比,添加这些上下文向量可以提高性能。

- ULMFit

- 提出了一种有效的转移学习方法,该方法可以应用于NLP中的任何任务。

- ELMo

- GPT

- 通过修改Transformer增强了上下文相关的嵌入。

- BERT

- 使用两种不同的预训练任务进行语言建模。 BERT随机掩盖句子中一定比例的单词,并学习预测那些被掩盖的单词。 此外,BERT学习预测两个句子是否相邻。

- MT-DNN

- 结合了预训练学习和多任务学习,以提高GLUE中多个不同任务的绩效。

- GPT-2

- 将任务信息添加到了预训练过程中,并使他们的模型适应零样本任务。

- XLM

- 在预训练过程中增加了语言嵌入功能,从而在跨语言任务中取得了更好的结果。

- 采用异构数据

- 通用句子编码器

- 采用了来自Wikipedia,网络新闻,Web质量检查页面和讨论论坛的异构训练数据。

- 基于响应预测的句子编码器

- 受益于从Reddit对话中提取的查询-响应对数据。

- XLM

- 向BERT引入了并行语料库,它与掩盖语言模型任务一起接受了训练

做了什么工作

BERT是字输入字掩码

ERNIE是字输入词掩码

而这个识别词的过程就是加入知识整合的点

采用多阶段的知识掩盖策略,而不是直接添加知识嵌入,而是将短语和实体级知识集成到语言表示中

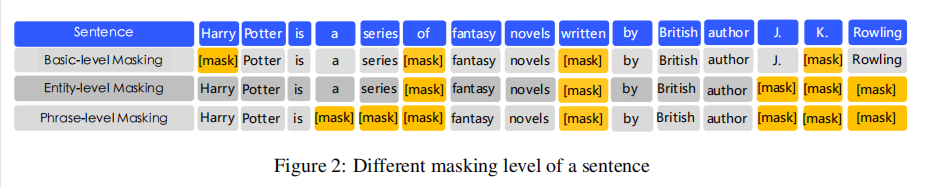

3.2.1基本级别掩码

第一个学习阶段是使用基本级别掩盖,它将句子作为基本语言单位的序列,对于英语,基本语言单位是单词,对于中文,基本语言单位是汉字。 在训练过程中,我们随机掩盖15%的基本语言单元,并使用句子中的其他基本单元作为输入,并训练一个Transformer来预测掩盖单元。 和BERT一样的操作,基于基本级别的掩码,学习低级语义。

3.2.2 短语级别掩码

第二阶段是采用短语级别的屏蔽。 词组是一小部分单词或字符,一起充当概念单元。 对于英语,我们使用词法分析和分块工具来获取句子中短语的边界,并使用一些依赖于语言的分段工具来获取其他语言(例如中文)的词/短语信息。 **在短语级掩码阶段,我们还使用基本语言单元作为训练输入,这与随机基本单元掩码不同,**这次我们随机选择句子中的几个短语,掩盖并预测同一短语中的所有基本单元。 在此阶段,短语信息被编码到单词嵌入中。

3.2.3实体级别掩码

第三阶段是实体级屏蔽。 名称实体包含人员,位置,组织,产品等,可以用专有名称表示。 它可以是抽象的,也可以是物理存在的。 通常,实体在句子中包含重要信息。 与短语屏蔽阶段一样,我们首先分析句子中的命名实体,然后屏蔽并预测实体中的所有时隙。 经过三个阶段的学习,获得了通过更丰富的语义信息增强的单词表示。

对话数据对于语义表示很重要,因为相同答复的相应查询语义通常很相似。 ERNIE在DLM(对话语言模型)任务上对查询-响应对话结构进行建模。如图3所示,我们的方法引入了对话嵌入(dialogue embedding)来识别对话中的角色,这与通用句子编码器的方法不同(Cer等人,2018)。 ERNIE的“对话”嵌入功能与BERT中的令牌类型嵌入功能相同,不同之处在于ERNIE还可以表示多回合对话(例如QRQ,QRR,QQR,其中Q和R分别代表“查询”和“响应”)。像BERT中的MLM一样,使用掩码来强制使模型预测以查询和响应为条件的缺失词。而且,我们通过用随机选择的句子替换查询或响应来生成假样本。该模型旨在判断多回合对话是真实的还是假的。

DLM任务可帮助ERNIE学习对话中的隐式关系,这也增强了模型学习语义表示的能力。DLM任务的模型体系结构与MLM任务的模型体系结构兼容,因此可以通过MLM任务对其进行预训练。

解决了什么问题

自然语言推理

语义相似性

命名实体识别

情感分析

问题解答

在完形填空测试中具有更强大的知识推理能力

创新点在哪里

1.mask策略。BERT只使用了字级别的随机masking,但是ERNIE使用了字、实体、短语三个级别的masking,旨在使模型学习到更多高级的语义。

2.中文异构数据预训练。对异构无监督数据进行预训练的语义编码器可以提高迁移学习性能。百度构建了混合语料库——中文Wikepedia,百度百科,百度新闻和百度贴吧。

3.对话语言模型。DLM任务可帮助ERNIE学习对话中的隐式关系,这也增强了模型学习语义表示的能力。

采用了什么数据

- 自然语言推理

- 跨语言自然语言推理(XNLI)语料库

- 是MultiNLI语料库的众包集合。 两对文字加上文字说明,并被翻译成包括中文在内的14种语言。 标签包含矛盾,中立和包含。

- 语义相似性

- 大规模中文问题匹配语料库(LCQMC)

- 旨在识别两个句子是否具有相同的意图。 数据集中的每一对句子都与一个二进制标签相关联,该二进制标签指示两个句子是否共享相同的意图,并且可以将该任务形式化为预测二进制标签。

- 命名实体识别

- MSRA-NER

- 由Microsoft Research Asia发布。 实体包含几种类型,包括人员姓名,地名,组织名称等。 该任务可以看作是序列标记任务。

- 情感分析

- ChnSentiCorp(Song-bo)

- 旨在判断句子的情感。 它包括酒店,书籍和电子计算机等多个领域的评论。 该任务的目的是判断句子是肯定的还是否定的。

- 问题解答

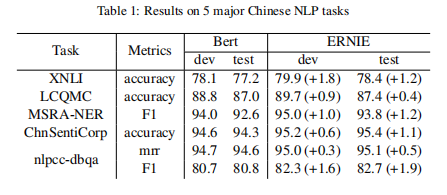

解决的效果怎么样

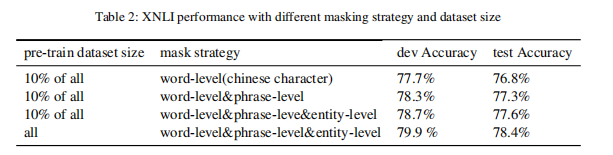

知识屏蔽策略的效果

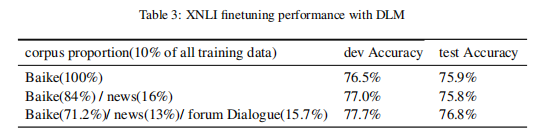

DLM的效果

完形填空效果

还能做哪些工作

将其他类型的知识整合到语义表示模型中,例如使用语法解析或来自其他任务的弱监督信号。

采用其他语言来验证这个想法