1 epoch

当一个完整的数据集通过神经网络一次并且返回一次的过程称为一个epoch。 然而,当一个epoch对于计算机太过庞大时,就需要把它分成多个小块。

2 batch

在不能将数据一次性通过神经网络的适合,就需要将数据集分成几个batch。

3 batch_size

直观的理解 一个batch中的样本总数(一次训练所选取的样本数)。batch_size的大小影响模型的优化程度和速度。同时其直接影响到GPU内存的使用情况,假如你GPU显存不大,该数值最好设置小一点。 提出batch_size的原因 在没有使用Batch Size之前,这意味着网络在训练时,是一次把所有的数据。

4 为什么要提出Batch Size?

在没有使用Batch Size之前,这意味着网络在训练时,是一次把所有的数据(整个数据库)输入网络中,然后计算它们的梯度进行反向传播,由于在计算梯度时使用了整个数据库,所以计算得到的梯度方向更为准确。但在这情况下,计算得到不同梯度值差别巨大,难以使用一个全局的学习率,所以这时一般使用Rprop这种基于梯度符号的训练算法,单独进行梯度更新。

在小样本数的数据库中,不使用Batch Size是可行的,而且效果也很好。但是一旦是大型的数据库,一次性把所有数据输进网络,肯定会引起内存的爆炸。所以就提出Batch Size的概念。

5 Batch Size设置合适时的优点:

1、通过并行化提高内存的利用率。就是尽量让你的GPU满载运行,提高训练速度。

2、单个epoch的迭代次数减少了,参数的调整也慢了,假如要达到相同的识别精度,需要更多的epoch。

3、适当Batch Size使得梯度下降方向更加准确。

6 Batch Size从小到大的变化对网络影响

1、没有Batch Size,梯度准确,只适用于小样本数据库

2、Batch Size=1,梯度变来变去,非常不准确,网络很难收敛。

3、Batch Size增大,梯度变准确,

4、Batch Size增大,梯度已经非常准确,再增加Batch Size也没有用

注意:Batch Size增大了,要到达相同的准确度,必须要增大epoch。

GD(Gradient Descent):就是没有利用Batch Size,用基于整个数据库得到梯度,梯度准确,但数据量大时,计算非常耗时,同时神经网络常是非凸的,网络最终可能收敛到初始点附近的局部最优点。

SGD(Stochastic Gradient Descent):就是Batch Size=1,每次计算一个样本,梯度不准确,所以学习率要降低。

mini-batch SGD:就是选着合适Batch Size的SGD算法,mini-batch利用噪声梯度,一定程度上缓解了GD算法直接掉进初始点附近的局部最优值。同时梯度准确了,学习率要加大。

对于mini-batch SGD:

7 为什么说Batch size的增大能使网络的梯度更准确?

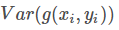

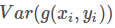

梯度的方差表示:

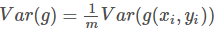

由于样本是随机选取的,满足独立同分布,所以所有样本具有相同的方差

所以上式可以简化成

可以看出当Batch size为m时,样本的方差减少m倍,梯度就更准确了。

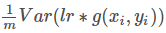

假如想要保持原来数据的梯度方差,可以增大学习率lr

,只要lr取

,只要lr取 ,上式就变成

,上式就变成

这也说明batch size设置较大时,一般学习率要增大。但是lrlr的增大不是一开始就设置的很大,而是在训练过程中慢慢变大。

一个具体例子分析:

在分布式训练中,Batch size随着数据并行的workers增加而增大,假如baseline的Batch Size为B,而学习率为lr,训练epoch为N。假如保持baseline的lr,一般达不到很好的收敛速度和精度。

原因:对于收敛速度,假如有K个workers,则每个批次为KB,因此一个epoch迭代的次数为baseline的1/k,而学习率lr不变,所以要达到与baseline相同的收敛情况,epoch要增大。而根据上面公式,epoch最大需要增大KN个epoch,但一般情况下不需要增大那么多。

对于收敛精度,由于Batch size的使用使梯度更准确,噪声减少,所以更容易收敛。

batchsize:中文翻译为批大小(批尺寸)。

简单点说,批量大小将决定我们一次训练的样本数目。

batch_size将影响到模型的优化程度和速度。

为什么需要有Batch_Size:

batchsize的正确选择是为了在内存效率和内存容量之间寻找最佳平衡。

Batch_Size的取值:

如果数据集比较小,我们就采用全数据集。全数据集确定的方向能够更好的代表样本总体,从而更准确的朝向极值所在的方向。

注:对于大的数据集,我们不能使用全批次,因为会得到更差的结果。

选择一个适中的Batch_Size值。就是说我们选定一个batch的大小后,将会以batch的大小将数据输入深度学习的网络中,然后计算这个batch的所有样本的平均损失,即代价函数是所有样本的平均。

每次修正方向以各自样本的梯度方向修正,横冲直撞各自为政,难以达到收敛。

适当的增加Batch_Size的优点:

1.通过并行化提高内存利用率。

2.单次epoch的迭代次数减少,提高运行速度。(单次epoch=(全部训练样本/batchsize)/iteration=1)

3.适当的增加Batch_Size,梯度下降方向准确度增加,训练震动的幅度减小。(看上图便可知晓)

经验总结:

相对于正常数据集,如果Batch_Size过小,训练数据就会非常难收敛,从而导致underfitting。

增大Batch_Size,相对处理速度加快。

增大Batch_Size,所需内存容量增加(epoch的次数需要增加以达到最好的结果)

这里我们发现上面两个矛盾的问题,因为当epoch增加以后同样也会导致耗时增加从而速度下降。因此我们需要寻找最好的Batch_Size。

再次重申:Batch_Size的正确选择是为了在内存效率和内存容量之间寻找最佳平衡。

iteration:中文翻译为迭代。

迭代是重复反馈的动作,神经网络中我们希望通过迭代进行多次的训练以达到所需的目标或结果。

每一次迭代得到的结果都会被作为下一次迭代的初始值。

一个迭代=一个正向通过+一个反向通过。

epoch:中文翻译为时期。

一个时期=所有训练样本的一个正向传递和一个反向传递。

深度学习中经常看到epoch、iteration和batchsize,下面说说这三个区别:

(1)batchsize:批大小。在深度学习中,一般采用SGD训练,即每次训练在训练集中取batchsize个样本训练;

(2)iteration:1个iteration等于使用batchsize个样本训练一次;

(3)epoch:1个epoch等于使用训练集中的全部样本训练一次;

举个例子,训练集有1000个样本,batchsize=10,那么:

训练完整个样本集需要:

100次iteration,1次epoch。

参考博客:

神经网络中Batch Size的理解_myc的博客-CSDN博客_batch size

神经网络中Epoch、Iteration、Batchsize相关理解和说明_Microstrong-CSDN博客_epoch