以下CUDA sample是分别用C++和CUDA实现的通过均值和标准差对图像进行类似归一化的操作,并对其中使用到的CUDA函数进行了解说,各个文件内容如下:

关于均值和标准差的计算公式可参考: http://blog.csdn.net/fengbingchun/article/details/73323475

funset.cpp:

#include "funset.hpp"

#include <random>

#include <iostream>

#include <vector>

#include <memory>

#include <string>

#include <algorithm>

#include "common.hpp"

#include <opencv2/opencv.hpp>

int test_image_normalize()

{

std::string image_name{ "E:/GitCode/CUDA_Test/test_images/lena.png" };

cv::Mat matSrc = cv::imread(image_name);

if (!matSrc.data) {

fprintf(stderr, "read image fail: %s\n", image_name.c_str());

return -1;

}

const int width{ 511 }, height{ 473 }, channels{ 3 };

cv::resize(matSrc, matSrc, cv::Size(width, height));

matSrc.convertTo(matSrc, CV_32FC3);

std::vector<cv::Mat> matSplit;

cv::split(matSrc, matSplit);

CHECK(matSplit.size() == channels);

std::unique_ptr<float[]> data(new float[matSplit[0].cols * matSplit[0].rows * channels]);

size_t length{ matSplit[0].cols * matSplit[0].rows * sizeof(float) };

for (int i = 0; i < channels; ++i) {

memcpy(data.get() + matSplit[0].cols * matSplit[0].rows * i, matSplit[i].data, length);

}

float elapsed_time1{ 0.f }, elapsed_time2{ 0.f }; // milliseconds

std::unique_ptr<float[]> dst1(new float[matSplit[0].cols * matSplit[0].rows * channels]);

std::unique_ptr<float[]> dst2(new float[matSplit[0].cols * matSplit[0].rows * channels]);

int ret = image_normalize_cpu(data.get(), dst1.get(), width, height, channels, &elapsed_time1);

if (ret != 0) PRINT_ERROR_INFO(image_normalize_cpu);

ret = image_normalize_gpu(data.get(), dst2.get(), width, height, channels, &elapsed_time2);

if (ret != 0) PRINT_ERROR_INFO(image_normalize_gpu);

int count{ 0 }, num{ width * height * channels };

for (int i = 0; i < num; ++i) {

if (fabs(dst1[i] - dst2[i]) > 0.01/*EPS_*/) {

fprintf(stderr, "index: %d, val1: %f, val2: %f\n", i, dst1[i], dst2[i]);

++count;

}

if (count > 100) return -1;

}

std::vector<cv::Mat> merge(channels);

for (int i = 0; i < channels; ++i) {

merge[i] = cv::Mat(height, width, CV_32FC1, dst2.get() + i * width * height);

}

cv::Mat dst3;

cv::merge(merge, dst3);

dst3.convertTo(dst3, CV_8UC3, 255.f);

cv::imwrite("E:/GitCode/CUDA_Test/test_images/image_normalize.png", dst3);

//cv::resize(matSrc, matSrc, cv::Size(width, height));

//cv::imwrite("E:/GitCode/CUDA_Test/test_images/image_src.png", matSrc);

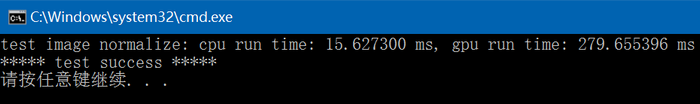

fprintf(stderr, "test image normalize: cpu run time: %f ms, gpu run time: %f ms\n", elapsed_time1, elapsed_time2);

return 0;

}

image_normalize.cpp:

#include "funset.hpp"

#include <vector>

#include <chrono>

#include "common.hpp"

int image_normalize_cpu(const float* src, float* dst, int width, int height, int channels, float* elapsed_time)

{

auto start = std::chrono::steady_clock::now();

const int offset{ width * height };

for (int i = 0; i < channels; ++i) {

const float* p1 = src + offset * i;

float* p2 = dst + offset * i;

float mean{ 0.f }, sd{ 0.f };

for (int t = 0; t < offset; ++t) {

mean += p1[t];

sd += pow(p1[t], 2.f);

p2[t] = p1[t];

}

mean /= offset;

sd /= offset;

sd -= pow(mean, 2.f);

sd = sqrt(sd);

if (sd < EPS_) sd = 1.f;

for (int t = 0; t < offset; ++t) {

p2[t] = (p1[t] - mean) / sd;

}

}

auto end = std::chrono::steady_clock::now();

auto duration = std::chrono::duration_cast<std::chrono::nanoseconds>(end - start);

*elapsed_time = duration.count() * 1.0e-6;

return 0;

}

image_normalize.cu:

#include "funset.hpp"

#include <iostream>

#include <memory>

#include <algorithm>

#include <cmath>

#include <cuda_runtime.h> // For the CUDA runtime routines (prefixed with "cuda_")

#include <device_launch_parameters.h>

#include "common.hpp"

/* __global__: 函数类型限定符;在设备上运行;在主机端调用,计算能力3.2及以上可以在

设备端调用;声明的函数的返回值必须是void类型;对此类型函数的调用是异步的,即在

设备完全完成它的运行之前就返回了;对此类型函数的调用必须指定执行配置,即用于在

设备上执行函数时的grid和block的维度,以及相关的流(即插入<<< >>>运算符);

a kernel,表示此函数为内核函数(运行在GPU上的CUDA并行计算函数称为kernel(内核函

数),内核函数必须通过__global__函数类型限定符定义);*/

__global__ static void image_normalize(const float* src, float* dst, int count, int offset)

{

/* gridDim: 内置变量,用于描述线程网格的维度,对于所有线程块来说,这个

变量是一个常数,用来保存线程格每一维的大小,即每个线程格中线程块的数量.

一个grid最多只有二维,为dim3类型;

blockDim: 内置变量,用于说明每个block的维度与尺寸.为dim3类型,包含

了block在三个维度上的尺寸信息;对于所有线程块来说,这个变量是一个常数,

保存的是线程块中每一维的线程数量;

blockIdx: 内置变量,变量中包含的值就是当前执行设备代码的线程块的索引;用

于说明当前thread所在的block在整个grid中的位置,blockIdx.x取值范围是

[0,gridDim.x-1],blockIdx.y取值范围是[0, gridDim.y-1].为uint3类型,

包含了一个block在grid中各个维度上的索引信息;

threadIdx: 内置变量,变量中包含的值就是当前执行设备代码的线程索引;用于

说明当前thread在block中的位置;如果线程是一维的可获取threadIdx.x,如果

是二维的还可获取threadIdx.y,如果是三维的还可获取threadIdx.z;为uint3类

型,包含了一个thread在block中各个维度的索引信息 */

int index = threadIdx.x + blockIdx.x * blockDim.x;

if (index > count - 1) return;

const float* input = src + index * offset;

float* output = dst + index * offset;

float mean{ 0.f }, sd{ 0.f };

for (size_t i = 0; i < offset; ++i) {

mean += input[i];

sd += pow(input[i], 2.f);

output[i] = input[i];

}

mean /= offset;

sd /= offset;

sd -= pow(mean, 2.f);

sd = sqrt(sd);

if (sd < EPS_) sd = 1.f;

for (size_t i = 0; i < offset; ++i) {

output[i] = (input[i] - mean) / sd;

}

}

int image_normalize_gpu(const float* src, float* dst, int width, int height, int channels, float* elapsed_time)

{

/* cudaEvent_t: CUDA event types,结构体类型, CUDA事件,用于测量GPU在某

个任务上花费的时间,CUDA中的事件本质上是一个GPU时间戳,由于CUDA事件是在

GPU上实现的,因此它们不适于对同时包含设备代码和主机代码的混合代码计时 */

cudaEvent_t start, stop;

// cudaEventCreate: 创建一个事件对象,异步启动

cudaEventCreate(&start);

cudaEventCreate(&stop);

// cudaEventRecord: 记录一个事件,异步启动,start记录起始时间

cudaEventRecord(start, 0);

float *dev_src{ nullptr }, *dev_dst{ nullptr };

size_t length{ width * height * channels * sizeof(float) };

// cudaMalloc: 在设备端分配内存

cudaMalloc(&dev_src, length);

cudaMalloc(&dev_dst, length);

/* cudaMemcpy: 在主机端和设备端拷贝数据,此函数第四个参数仅能是下面之一:

(1). cudaMemcpyHostToHost: 拷贝数据从主机端到主机端

(2). cudaMemcpyHostToDevice: 拷贝数据从主机端到设备端

(3). cudaMemcpyDeviceToHost: 拷贝数据从设备端到主机端

(4). cudaMemcpyDeviceToDevice: 拷贝数据从设备端到设备端

(5). cudaMemcpyDefault: 从指针值自动推断拷贝数据方向,需要支持

统一虚拟寻址(CUDA6.0及以上版本)

cudaMemcpy函数对于主机是同步的 */

cudaMemcpy(dev_src, src, length, cudaMemcpyHostToDevice);

/* <<< >>>: 为CUDA引入的运算符,指定线程网格和线程块维度等,传递执行参

数给CUDA编译器和运行时系统,用于说明内核函数中的线程数量,以及线程是如何

组织的;尖括号中这些参数并不是传递给设备代码的参数,而是告诉运行时如何

启动设备代码,传递给设备代码本身的参数是放在圆括号中传递的,就像标准的函

数调用一样;不同计算能力的设备对线程的总数和组织方式有不同的约束;必须

先为kernel中用到的数组或变量分配好足够的空间,再调用kernel函数,否则在

GPU计算时会发生错误,例如越界等;

使用运行时API时,需要在调用的内核函数名与参数列表直接以<<<Dg,Db,Ns,S>>>

的形式设置执行配置,其中:Dg是一个dim3型变量,用于设置grid的维度和各个

维度上的尺寸.设置好Dg后,grid中将有Dg.x*Dg.y个block,Dg.z必须为1;Db是

一个dim3型变量,用于设置block的维度和各个维度上的尺寸.设置好Db后,每个

block中将有Db.x*Db.y*Db.z个thread;Ns是一个size_t型变量,指定各块为此调

用动态分配的共享存储器大小,这些动态分配的存储器可供声明为外部数组

(extern __shared__)的其他任何变量使用;Ns是一个可选参数,默认值为0;S为

cudaStream_t类型,用于设置与内核函数关联的流.S是一个可选参数,默认值0. */

image_normalize << < channels, 512 >> >(dev_src, dev_dst, channels, width*height);

cudaMemcpy(dst, dev_dst, length, cudaMemcpyDeviceToHost);

// cudaFree: 释放设备上由cudaMalloc函数分配的内存

cudaFree(dev_src);

cudaFree(dev_dst);

// cudaEventRecord: 记录一个事件,异步启动,stop记录结束时间

cudaEventRecord(stop, 0);

// cudaEventSynchronize: 事件同步,等待一个事件完成,异步启动

cudaEventSynchronize(stop);

// cudaEventElapseTime: 计算两个事件之间经历的时间,单位为毫秒,异步启动

cudaEventElapsedTime(elapsed_time, start, stop);

// cudaEventDestroy: 销毁事件对象,异步启动

cudaEventDestroy(start);

cudaEventDestroy(stop);

return 0;

}

原图如下:

结果图如下:

执行结果如下:由运行时间可知,GPU要远慢于CPU,后面再对GPU实现进行优化。还有一个问题是,在Release下,执行正常,在Debug下,GPU,在调用核函数时,会在for循环中无故退出,具体原因还未知,后面待进一步分析。

GitHub: https://github.com/fengbingchun/CUDA_Test