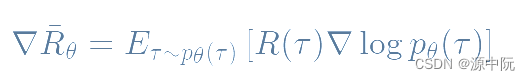

第四章 Policy Gradient梯度策略

例子

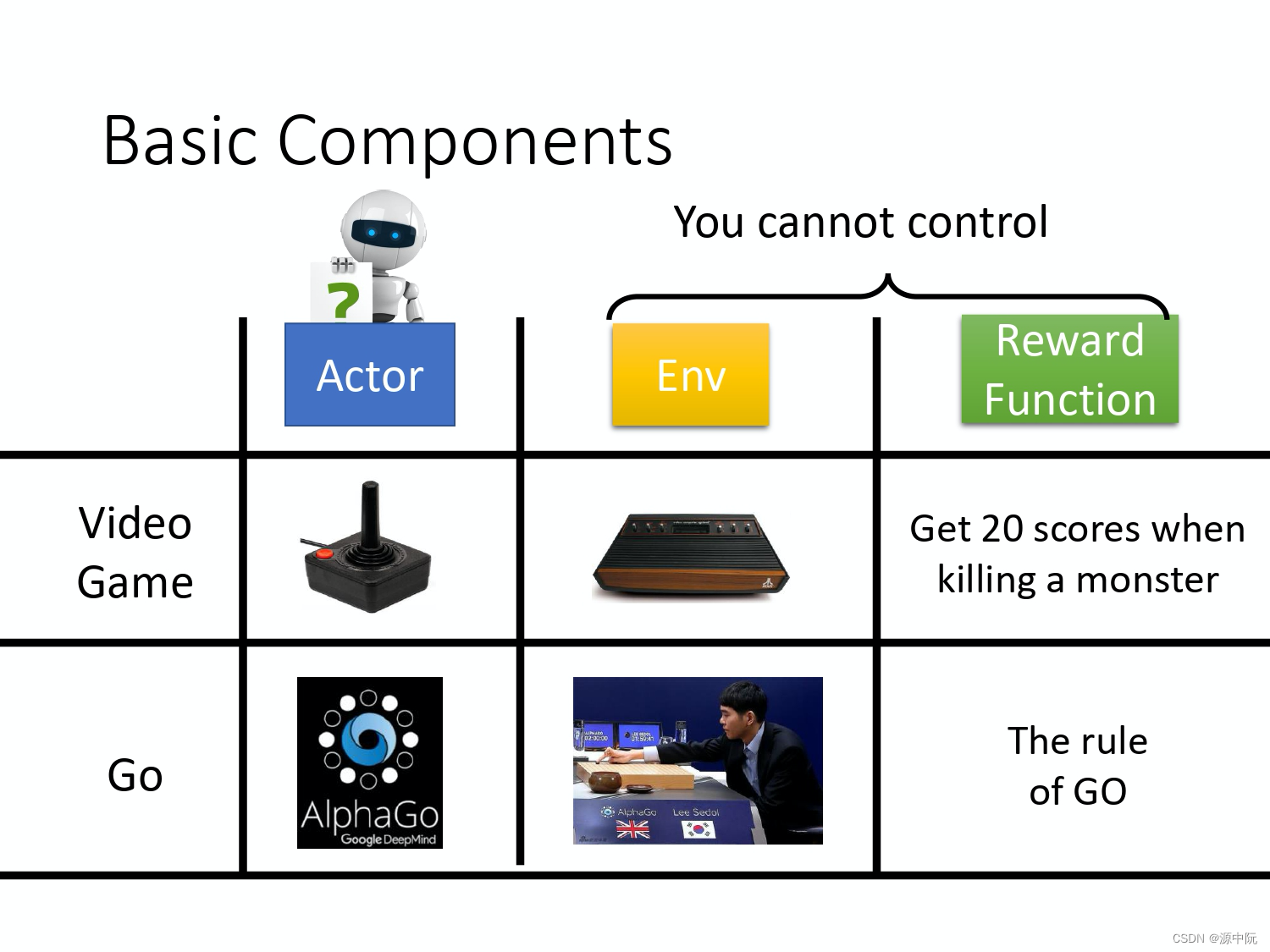

在强化学习中有 3 个组成部分:智能体(actor)、环境(environment) 和 奖励函数(reward function)。

在强化学习里面,环境跟奖励函数不可控制,环境跟奖励函数是在开始学习之前,就已经事先给定的。唯一能做的事情是调整智能体里面的策略(policy),使得智能体可以得到最大的奖励。智能体里面会有一个策略,这个策略决定了智能体的行为。给定一个外界的输入,策略会输出演员现在应该要执行的行为。

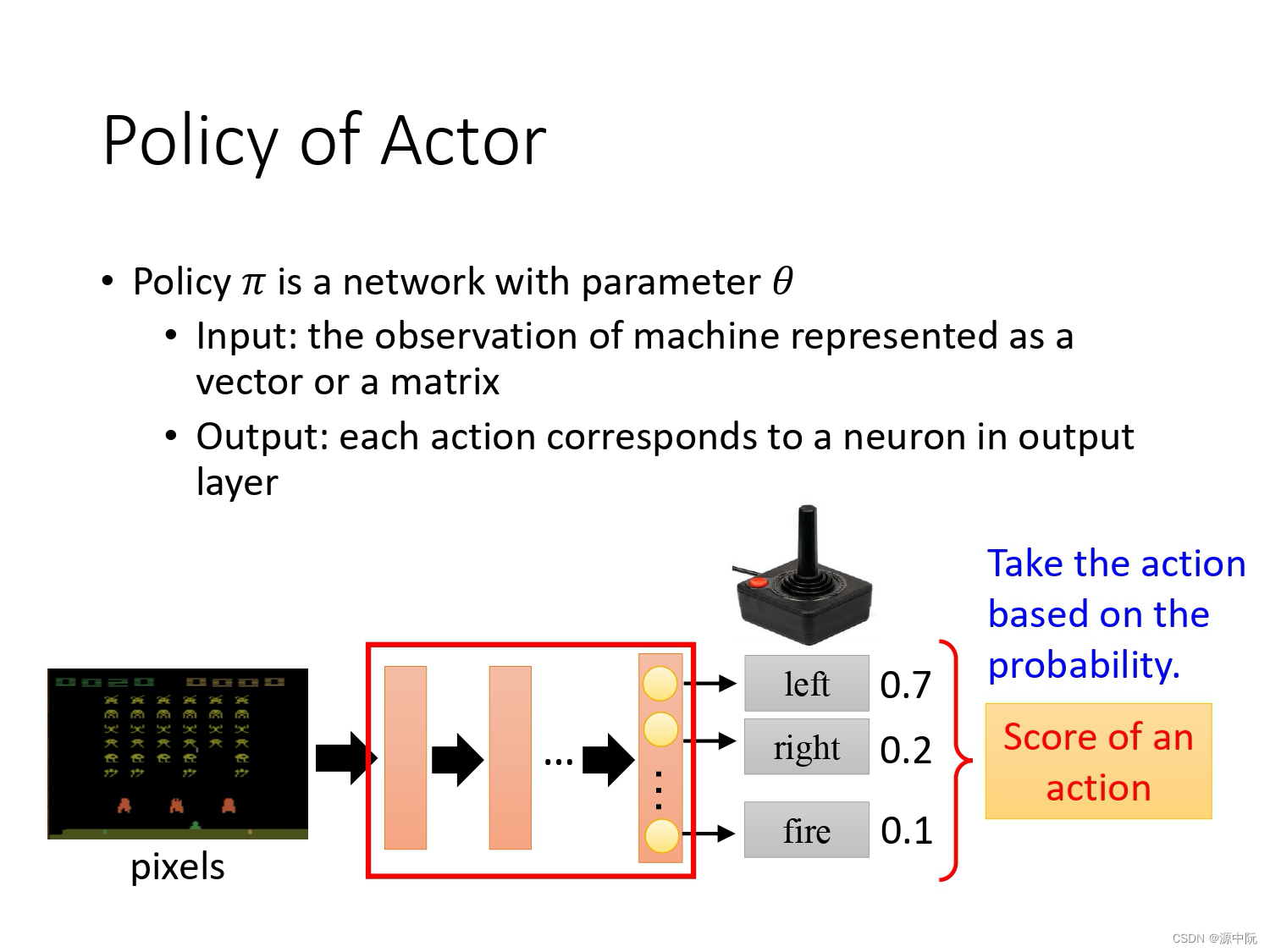

以雅达利游戏为强化学习例子,其可以看出,

1.策略就是一个网络;

2.输入就是游戏的画面,它通常是由像素(pixels)所组成的;

3.输出就是看看说有哪些选项是你可以去执行的,输出层就有几个神经元。

4.假设你现在可以做的行为有 3 个,输出层就是有 3 个神经元。每个神经元对应到一个可以采取的行为。

5.输入一个东西后,网络就会给每一个可以采取的行为一个分数,可以当作是概率。演员就是看这个概率的分布,根据这个概率的分布来决定它要采取的行为。比如说 70% 会向左走,20% 向右走,10% 开火等等。概率分布不同,演员采取的行为就会不一样。

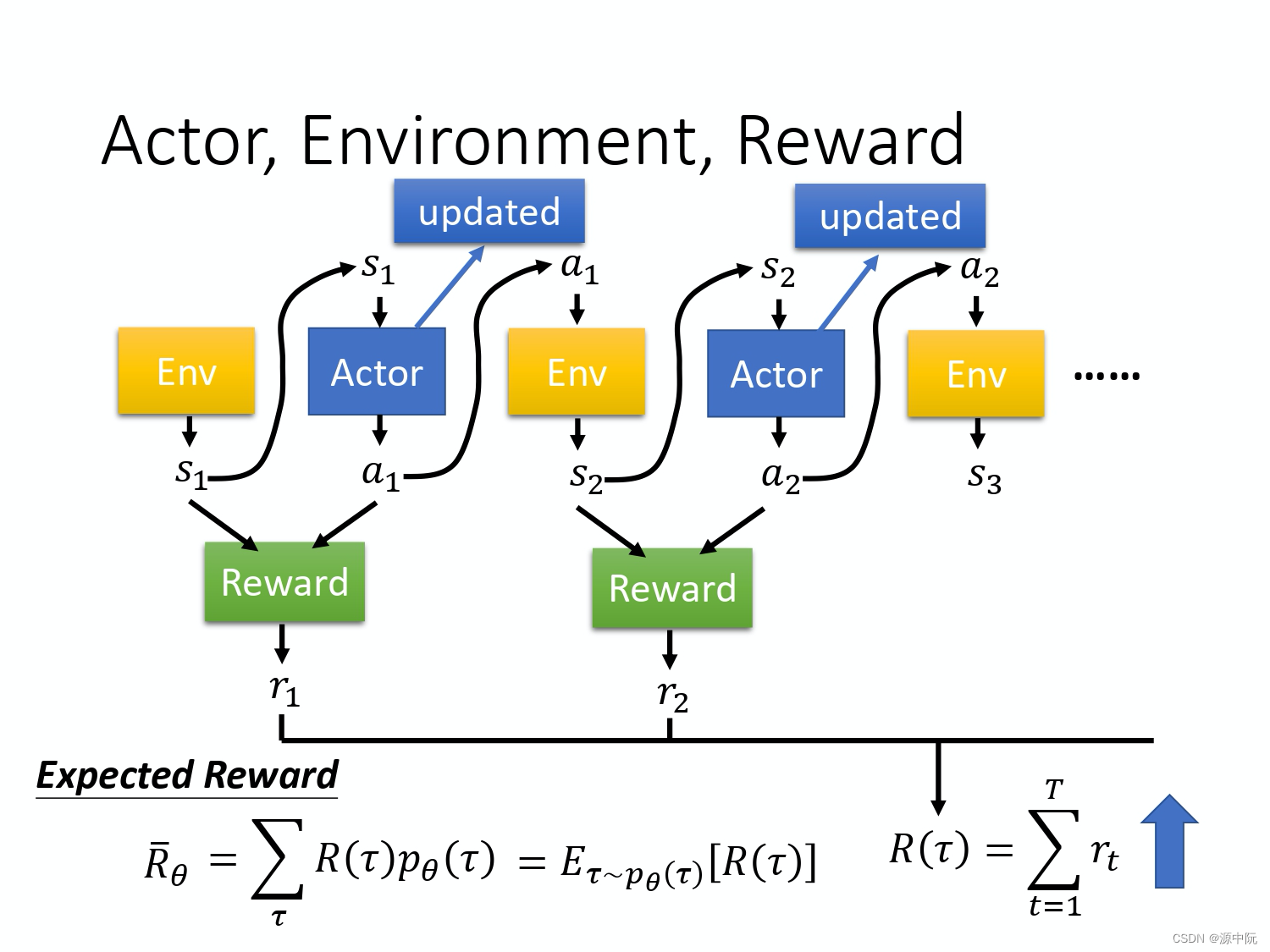

首先,环境是一个函数,在一场游戏里面,我们把环境输出的 ss 跟演员输出的行为 aa,把 ss 跟 aa 全部串起来, 叫做一个 Trajectory(轨迹),如下式所示。

Trajectory

τ

=

{

s

1

,

a

1

,

s

2

,

a

2

,

⋯

,

s

t

,

a

t

}

\text { Trajectory } \tau=\left\{s_{1}, a_{1}, s_{2}, a_{2}, \cdots, s_{t}, a_{t}\right\}

Trajectory τ={s1,a1,s2,a2,⋯,st,at}

你其实可以计算某一个轨迹发生的概率,你可以计算某一个回合里面发生这样子状况的概率。

p

θ

(

τ

)

=

p

(

s

1

)

p

θ

(

a

1

∣

s

1

)

p

(

s

2

∣

s

1

,

a

1

)

p

θ

(

a

2

∣

s

2

)

p

(

s

3

∣

s

2

,

a

2

)

⋯

=

p

(

s

1

)

∏

t

=

1

T

p

θ

(

a

t

∣

s

t

)

p

(

s

t

+

1

∣

s

t

,

a

t

)

\begin{aligned} p_{\theta}(\tau) &=p\left(s_{1}\right) p_{\theta}\left(a_{1} \mid s_{1}\right) p\left(s_{2} \mid s_{1}, a_{1}\right) p_{\theta}\left(a_{2} \mid s_{2}\right) p\left(s_{3} \mid s_{2}, a_{2}\right) \cdots \\ &=p\left(s_{1}\right) \prod_{t=1}^{T} p_{\theta}\left(a_{t} \mid s_{t}\right) p\left(s_{t+1} \mid s_{t}, a_{t}\right) \end{aligned}

pθ(τ)=p(s1)pθ(a1∣s1)p(s2∣s1,a1)pθ(a2∣s2)p(s3∣s2,a2)⋯=p(s1)t=1∏Tpθ(at∣st)p(st+1∣st,at)

(这里可以理解为,是一系列的条件概率,这里条件概率相关的公式都快忘差不多了,这里补上)

贝叶斯公式补充

贝叶斯公式:

P

(

X

j

∣

Y

i

)

=

p

(

y

i

∣

x

j

)

p

(

x

i

)

∑

j

=

1

n

p

(

y

i

∣

x

j

)

p

(

x

j

)

)

P(X_j | Y_i) = \frac{p(y_i|x_j)p(x_i)}{\sum_{j=1}^{n} p(y_i |x_j) p(x_j))}

P(Xj∣Yi)=∑j=1np(yi∣xj)p(xj))p(yi∣xj)p(xi)

基于此,可以计算单个轨迹发生的概率。这个概率取决于两部分:

1.环境的行为 。环境的函数内部的参数或内部的规则长什么样子。

p

(

s

t

+

1

∣

s

t

,

a

t

)

p(s_t+1∣s_t,a_t)

p(st+1∣st,at)这一项代表的是环境,通常无法控制。

2.agent 的行为。你能控制的是

p

θ

(

a

t

∣

s

t

)

p_θ(a_t∣s_t)

pθ(at∣st)给定一个

s

t

s_t

st,演员要采取什么样的

a

t

a_t

at,会取决于演员的参数

θ

θ

θ,所以这部分是演员可以自己控制的。随着演员的行为不同,每个同样的轨迹, 它就会有不同的出现的概率。

奖励函数(reward function)

奖励函数根据在某一个状态采取的某一个动作,决定现在这个行为可以得到多少的分数。

在算法中,主要做的就是调整actor内部参数

θ

\theta

θ,使R越大越好。但由于R是一个随机变量,由动作和环境同时决定,只能计算R的期望值。即给定一组

θ

\theta

θ,计算

R

θ

R_\theta

Rθ的期望是多少。

R

ˉ

θ

=

∑

τ

R

(

τ

)

p

θ

(

τ

)

=

E

τ

−

p

θ

(

τ

)

[

R

(

τ

)

]

\bar{R}_{\theta}=\sum_{\tau} R(\tau) p_{\theta}(\tau)=E_{\tau-p_\theta(\tau)}[R(\tau)]

Rˉθ=τ∑R(τ)pθ(τ)=Eτ−pθ(τ)[R(τ)]

目标就是,将期望奖励最大化。

最大化方法–梯度上升

PPO算法

从 On-policy 到 Off-policy

在讲 PPO 之前,我们先回顾下 on-policy 和 off-policy 这两种训练方法的区别。 在强化学习里面,我们要学习的就是一个 agent。

如果要学习的 agent 跟和环境互动的 agent 是同一个的话, 这个叫做on-policy(同策略)。

如果要学习的 agent 跟和环境互动的 agent 不是同一个的话, 那这个叫做off-policy(异策略)。

近端策略优化(Proximal Policy Optimization,简称 PPO) 是 policy gradient 的一个变形,它是现在 OpenAI 默认的强化学习算法。