在面向物联网、大流量等场景下,为了满足更广连接、更低时延、更好控制等需求,云计算在向一种更加全局化的分布式节点组合形态进阶,边缘计算是其向边缘侧分布式拓展的新触角。

以物联网场景举例,设备产生大量数据,上传到云端进行处理,会对云端造成巨大压力,为分担云端的压力,边缘计算节点可以负责自己范围内的数据计算。

同时,经过处理的数据从边缘节点汇聚到中心云,云计算做大数据分析挖掘、数据共享,同时进行算法模型的训练和升级,升级后的算法推送到边缘,使边缘设备更新和升级,完成自主学习闭环。

对于边缘AI总体来说,核心诉求是高性能、低成本、高灵活性。其技术发展趋势可总结为以下几点:

- 可编程性、通用性;

- 伸缩性,同一个架构支持不同场景

- 低功耗,适应更多边缘场景的环境和电力要求

- 软硬件深度结合

- 高效的分布式互联和协作计算能力

笔者分别从边缘计算AI加速、端/边/云协同以及边缘计算AI框架等三个部分继续深入剖析AI应用与边缘计算结合之后的双向优化,进一步优化AI应用的用户体验。

1、边缘计算AI加速

针对基于边缘计算场景进行AI加速,笔者参考相关论文认为大致可归结为以下四个方面:

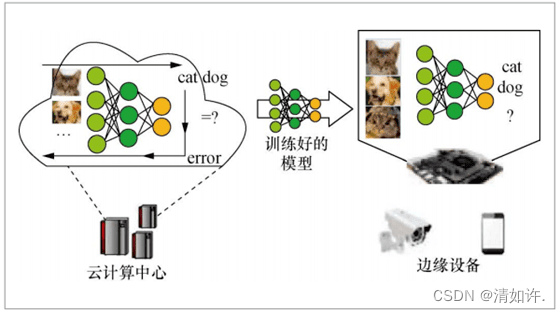

1.1 云边协同(云端训练、边缘推理)

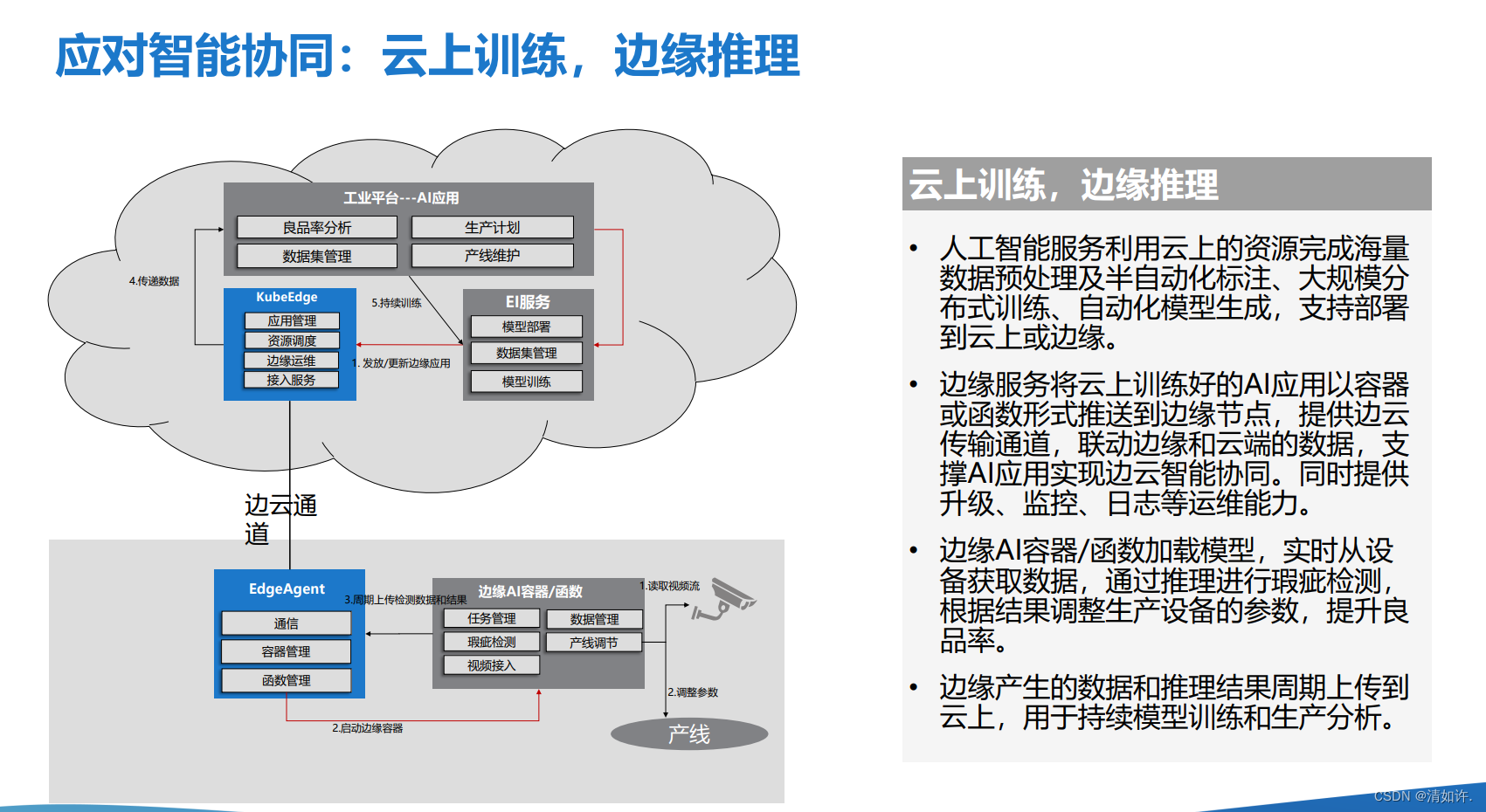

为弥补边缘设备计算、存储等能力的不足,满足人工智能方法训练过程中对强大计算能力、存储能力的需求,研究人员提出云计算和边缘计算协同服务架构。如下图所示,研究人员提出将训练过程部署在云端,而将训练好的模型部署在边缘设备。显然,这种服务模型能够在一定程度上弥补人工智能在边缘设备上对计算、存储等能力的需求。

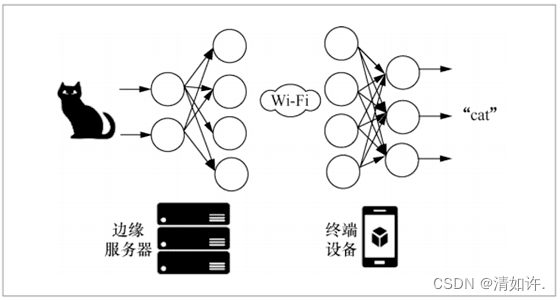

1.2 模型分割(云边协同推理)

为了将人工智能方法部署在边缘设备,如下图提出了切割训练模型,它是一种边缘服务器和终端设备协同训练的方法。它将计算量大的计算任务卸载到边缘端服务器进行计算,而计算量小的计算任务则保留在终端设备本地进行计算。显然,上述终端设备与边缘服务器协同推断的方法能有效地降低深度学习模型的推断时延。然而,不同的模型切分点将导致不同的计算时间,因此需要选择最佳的模型切分点,以最大化地发挥终端与边缘协同的优势。

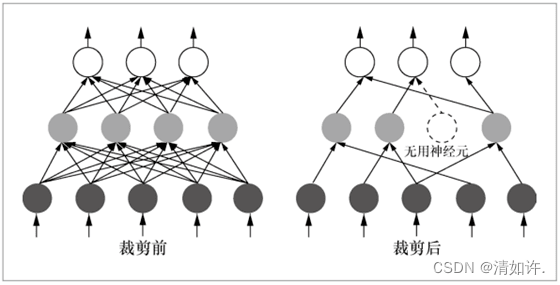

1.3 模型裁剪

为了减少人工智能方法对计算、存储等能力的需求,一些研究人员提出了一系列的技术,在不影响准确度的情况下裁剪训练模型,如在训练过程中丢弃非必要数据、稀疏数据表示、稀疏代价函数等。下图展示了一个裁剪的多层感知网络,网络中许多神经元的值为零,这些神经元在计算过程中不起作用,因而可以将其移除,以减少训练过程中对计算和存储的需求,尽可能使训练过程在边缘设备进行。在参考文献中,作者也提出了一些压缩、裁剪技巧,能够在几乎不影响准确度的情况下极大地减少网络神经元的个数。

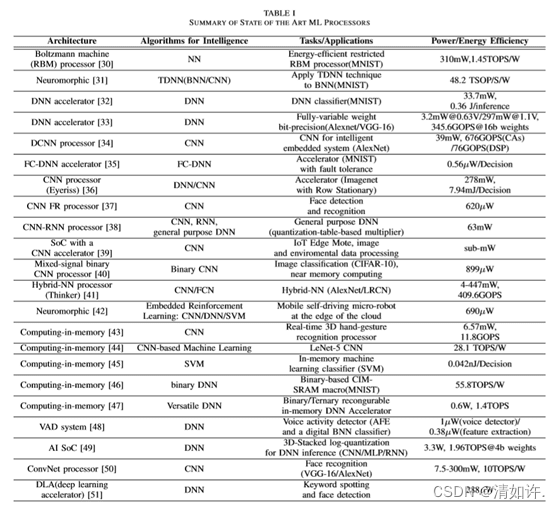

1.4 设计轻量级加速体系架构

在工业界,有很多公司开始研究低功耗加速芯片。如寒武纪公司推出的思元系列及华为公司推出的昇腾系列,能够适配并兼容多样化的硬件架构,进而支撑边缘计算典型的应用场景。

在学术界,对于边缘AI硬件的设计工作主要集中在提高深度神经网络及相关算法如CNN、FCN和RNN等的计算性能和效率。研究人员利用神经网络的冗余和弹性等特性来优化计算操作和数据移动,以降低NN算法在专用硬件上的功耗并提高性能。下表总结了一些低功耗机器学习处理器的相关情况。

AI在过去几年中,为互联网应用、工业互联网、医学和生物学及自动驾驶等领域带来了突飞猛进的进展。同时,随着边缘计算的逐步成熟,业界必将更加关注边缘计算AI加速方面的研究进展。

由于边缘计算场景的特点,其硬件的异构化程度会显著高于传统数据中心,对现有计算框架也会有非常大的挑战。如何快速支持异构的计算芯片并保证计算的高效,也非常值得产业内的研发力量持续投入。

2 端/边/云协同

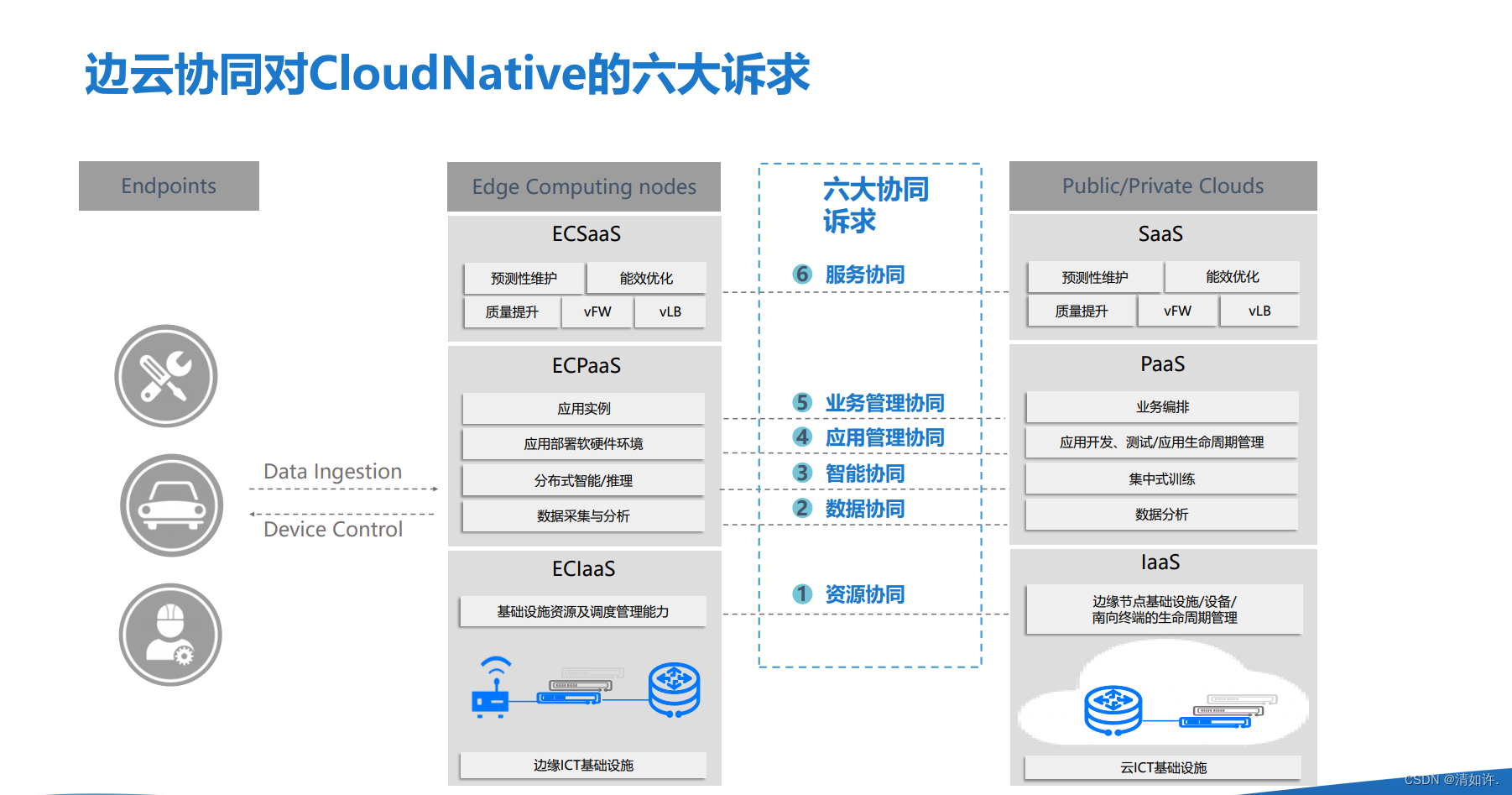

在云边协同的过程中,边缘计算主要对需要实时处理的数据进行处理,并为云端提供高价值的数据;云计算则负责非实时、长周期数据的处理,并完成边缘应用的全生命周期管理。下面分别介绍这6种协同方式。

- IaaS:基础设施服务,Infrastructure-as-a-service

- PaaS:平台服务,Platform-as-a-service

- SaaS:软件服务,Software-as-a-service

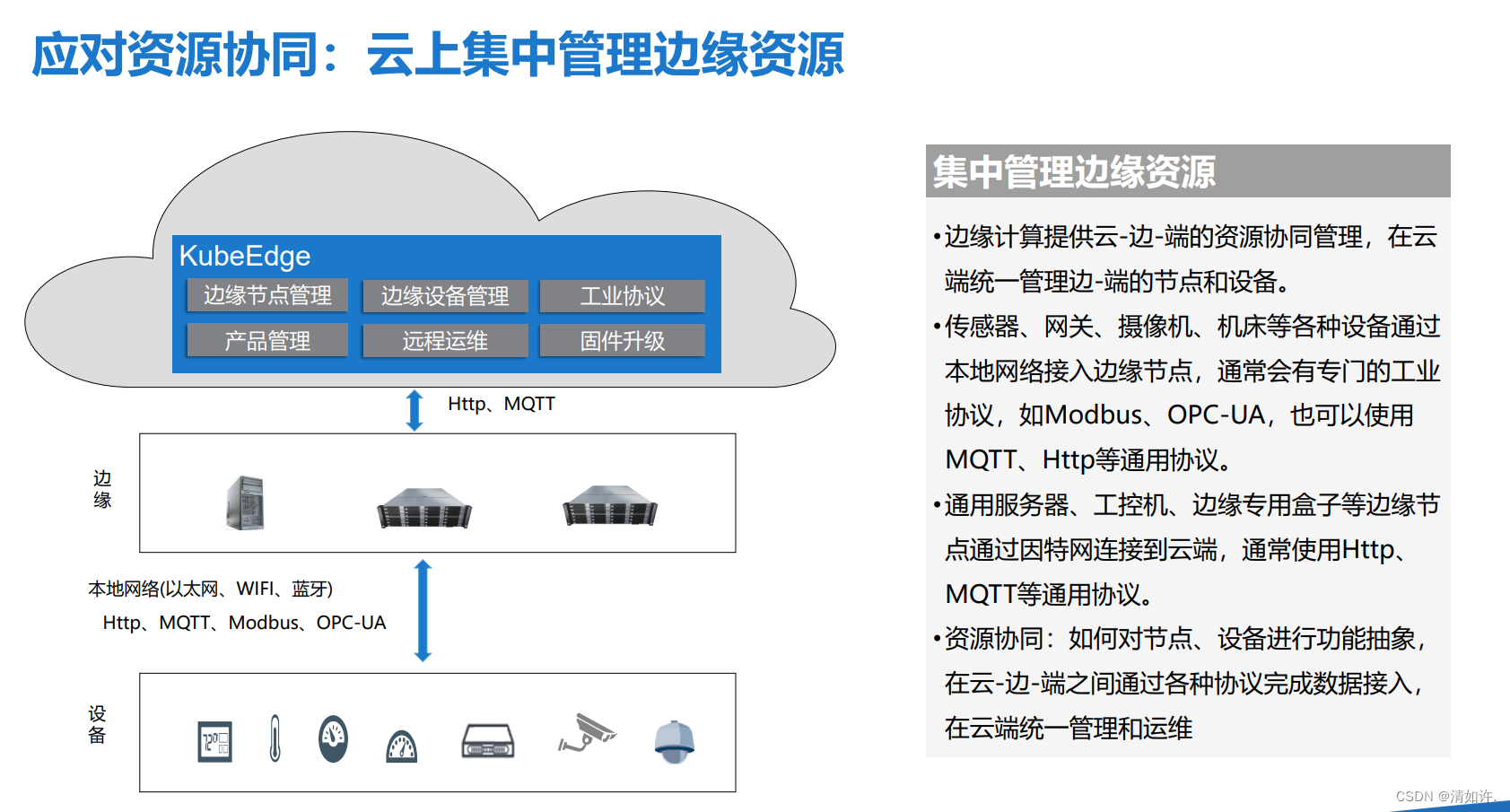

2.1 资源协同

资源协同:边缘节点提供计算、存储、网络、虚拟化等基础设施资源,具有本地资源调度管理能力,也接收并执行云端的资源调度管理策略;云端则提供资源调度管理策略,包括边缘节点的设备管理、资源管理以及网络连接管理。

对于边缘计算,需要对计算资源和网络资源有全局的判断,比如边缘设备、边缘节点及中心云资源的使用情况,站在全局角度,进行资源的合理分配,确保性能、成本、服务最优。

2.1.1 计算卸载

近年来,人们提出了两种计算卸载方法:卸载到云端和卸载到边缘端。其中,卸载到云端允许用户将计算密集型任务卸载到资源强大的云服务器上进行处理;卸载到边缘端是在网络边缘部署云服务,以提供相邻的 IT 服务环境。许多研究者利用这两种方法来研究时延最小化和能耗最小化问题。然而,卸载到云端会因传输距离远而无法很好地处理时延敏感性应用,因此目前大多数研究是把计算任务卸载到边缘端。

2.1.2 资源管理策略

资源管理策略一直都是学术界和产业界的研究重点,包括边缘端的本地资源管理与云端的资源管理。边缘计算与云计算协同的资源管理策略对于数据密集型计算非常重要。例如,智能交通、智慧城市以及无人驾驶汽车等都需要减少服务器延迟并提高 Qos.

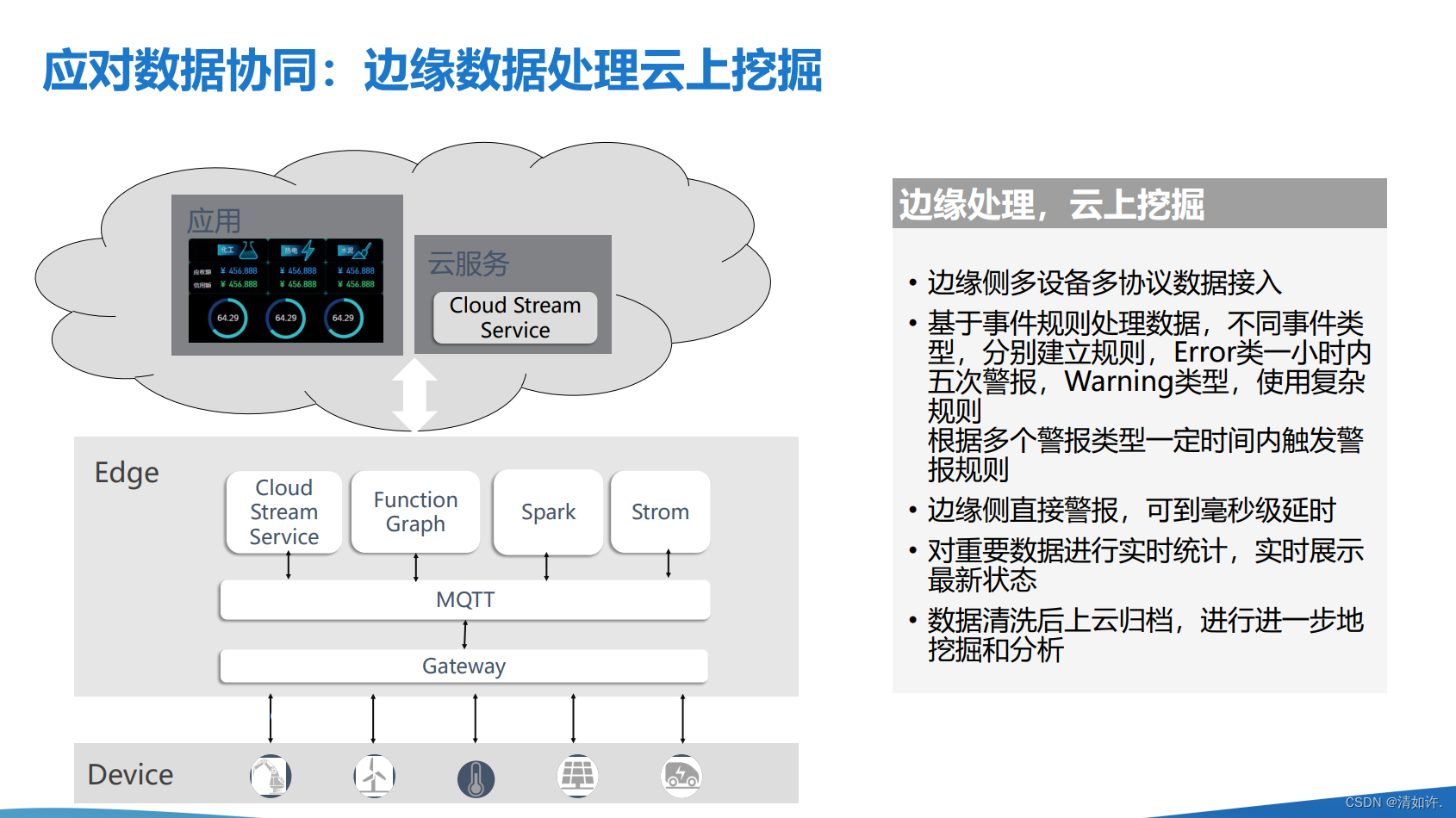

2.2 数据协同

边缘节点负责终端设备数据的收集,并对数据进行初步处理与分析,然后将处理后的数据发送至云端;云端对海量的数据进行存储、分析与价值挖掘。主要包括两个要点:

- 数据收集与处理

- 数据存储与分析

边缘AI会处理用户的数据,可以从两个维度来考虑。

一方面,横向考虑,边缘的网络环境多种多样,终端用户设备具有移动性,可能会从一个服务节点移动到另一个服务节点,从一个边缘移动到另一个边缘,从WiFi切换为5G移动网络,甚至从一个运营商切换到另一个运营商,那么用户在旧的环境中产生的数据如何与新环境中的AI程序进行同步会成为一个问题。这里的数据协同不仅需要技术上的支持,更需要商业模式上的支持。

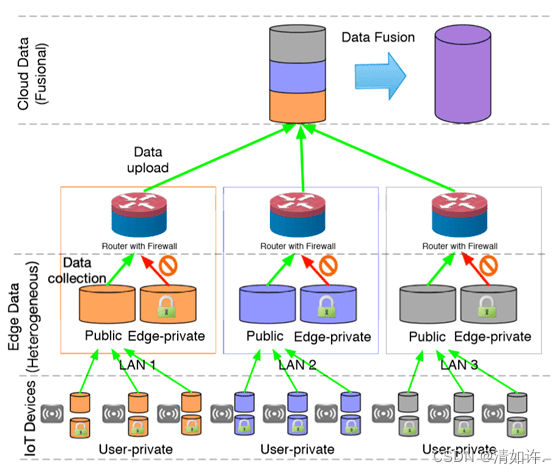

另一方面,纵向考虑,如下图所示,用户在边缘侧产生的数据按照隐私级别可以分为不同类型,如User-Private、Edge-Private、Public等,这些数据可以自下而上分层储存在云边协同系统中的不同层级的数据库中,同时也可以对应不同算力支持的边缘AI的访问权限,例如可以允许云上运行的AI程序读取Public数据来训练一个通用的模型,在边缘侧的AI可以读取Edge-Private数据来在通用模型的基础上训练边缘模型等等。

2.3 智能协同

边缘端负责深度学习模型的推理,实现分布式智能;云端负责深度学习模型的集中式训练,然后将训练好的模型下发至边缘端。

以往的研究都是在云端进行人工智能模型的训练、优化和推理,原因是模型的训练和优化需要大量的资源,云服务则是最适合的方案。然而,模型的推理需要的资源比训练、优化少得多,并且有新数据需要实时推理。因 此,在边缘侧进行模型的推理已逐渐成为新的研究热点。考虑到边缘节点的计算存储资源有限,如何减小模型大小和优化模型在边缘推理中 显得尤为重要。常见模型压缩方法主要包括网络剪枝、知识蒸馏、参数量化、结构优化。

- 1)网络剪枝,通常网络模型参数过多有些权重接近0,或者神经元的输出为 0,可以将这些多余的参数从网络中移除。具体步骤为预训练一个比较庞大的模型,评估每个权重和神经元的重要性,按照参数重要性排序,删除不重要的参数,将缩小的模型用训练数据重新微调一次,可以减小损失,如果模型缩小之后仍然没达到要求则重新评估权重和神经元迭代操作。

- 2)知识蒸馏,基本思想是可以先训练一个规模大的初始网络,再训练一个小的子网络去学习大的初始网络的行为。使用初始网络的输出来训练而不直接使用标注数据,是因为初始网络可以提供更多的信息,输入一个样本后初始网络会输出各种类别的概率值,这比单纯的标签信息要更丰富。

- 3)参数量化,如果说网络剪枝是通过减少权重的数量来压缩模型,那么量化则是通过减少权重的大小来压缩模型。量化通常是将大集合值映射到小集合值的过程,这意味着输出包含的可能值范围比输入小,理想情况下在该过程中不会丢失太多信息[86]。参数量化会使用更少的空间的来存储一个参数,然后使用聚类中心来代替整个类的值,这样可以减少参数的储存。

- 4)结构优化,通过调整网络结构使得其只需要较少的参数,常见方法为低秩近似与切除分离卷积。深层神经网络通常存在大量重复参数,不同层或通道之间存在许多相似性或冗余性,低秩近似的目标是使用较少滤波器的线性组合来近似一个层的大量冗余滤波器,以这种方式压缩层减少了网络的内存占用以及卷积运算的计算复杂性,实现加速。切除分离卷积方法则是将计算进行拆分,共用部分参数,最终实现参数规模缩小。

通过合理的模型拆解,将不同的服务模型根据资源、成本、质量、时延等要求部署在合适的位置。通过完成的协同计算框架,确保各子模型之间的协同处理。比如结合产品设计,我们可以将简单的识别推理全部置于端侧设备,如需要判断视频中的物体属于动物还是植物等。

但是进一步的识别功能,我们可以结合边缘侧的推理能力,识别动物为猫科动物或犬科动物等。如果用户需要更加精细的识别,我们可以将边缘侧的识别结果及处理之后得到的特征数据发送至云端,结合云端完善的数据模型和知识体系,将该猫科动物判定为是东北虎还是华南虎。这样通过端、边、云三者的协同,能够在极大保证用户体验的同时,合理的使用各类资源。

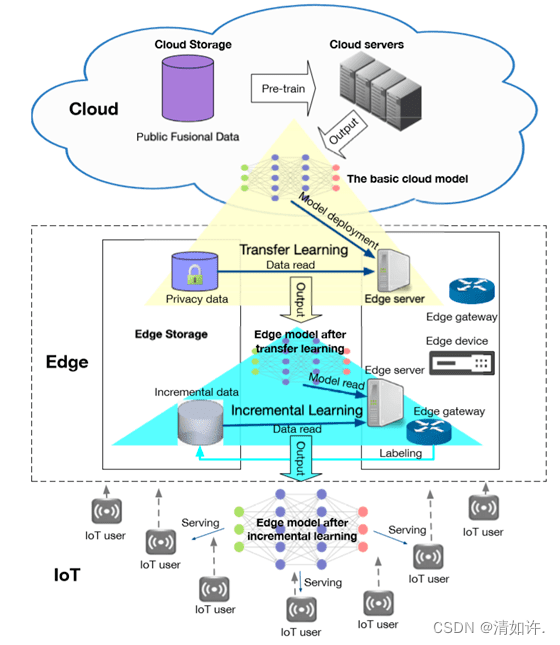

合理利用算力协同,也能够做到在边缘侧进行训练。目前工业界还没有成熟的模式,但学术界有相关的研究。如下图所示的ICE智能协同计算框架,将边缘AI的训练分为三个阶段:

- 第一阶段为预训练阶段(pre-train),云上的应用可以通过读取云端存储的公共数据,来训练一个通用的模型,这是边缘AI的底座,如果没有云端强大算力的帮助,只靠边缘侧算力是难以得到比云端训练更优秀的AI模型。

- 第二阶段将通用模型下发至边缘侧,读取边缘私有数据,通过转移学习(Transfer Learning),来得到边缘模型。

- 第三阶段读取增量数据,利用增量学习(Incremental Learning)生成最终边缘模型,这个最终边缘模型就可以用于用户侧的推理了。

这种三步学习的算力协同的模式,可以更好地满足边缘智能的个性化服务需求。

通过资源协同、算力协同以及数据协同,边缘智能能够高效合理的利用端、边、云的各类资源,极大地优化AI应用在边缘计算场景下的用户体验,进一步放大AI应用的商业价值。

2.4 业务编排协同

边缘节点提供模块化、微服务化的应用实例;云端提供按照客户需求实现业务的编排能力。

与传统的集中式处理的大型应用程序不同,微服务可 以实现功能模块之间的完全解耦。边缘节点通过模块化分解,将一个对象分解为具有特定接口的单个模块。每个模块服务于一个特定的功能,通过指定的接口进行连接,而每个功能都有多个应用实例。用户通过在服务器调用应用实例来访问服务实现请求,具有相同功能的多个服务实例可以部署在不同的服务器上,使得边缘服务器提供应用实例成为快速响应用户请求与时延敏感性应用程序的不二之选。

2.5 应用管理协同

最近有些研究关注边缘计算应用的部署与运行环境,这是因为边缘计算提供分布式云计算功能和高性能、低延迟、高带宽的服务环境。然而,应用类型和所处边缘位置的不同,会导致边缘计算硬件的选择部署和提供的环境不同。例 如,边缘用户端节点设备采用低成本、低 功 耗 的 ARM 处 理 器 或 者英特尔 Atom 处理器;边缘基站服务器采用英特尔至强系列处理器。而微服务、容器及虚拟化技术等的云原生软件架构能够减少因硬件基础设施差异化带来的部署及运维问题。

如今,越来越多有影响力的 IT 公司或应用程序供应商开始借助微服务技术(如 Kubernetes)来开发复杂的应用程序。此外,借助基于容器的技术,这些基于微服务的应用程序可以轻松地部署在边缘服务器上。考虑到物联网应用程序是分布式的,且通常包含多个计算密集型任务,因此需要在每个单独的计算节点上完成应用程序的部署与管理。研究者一直在探索如何找到一个合适的、低成本的应用程序部署方案。CNCF云原生基金会开源的Kubeedge通过 Kubernetes管理远程边缘节点并使用相同的API将应用程序部署到边缘并进行管理,给应用程序带来了更好的性能,同时提升了用户体验。

2.6 服务协同

服务协同主要是指边缘计算的边缘服务与云计算的云服务进行协同。边缘节点按照云端策略实现部分EC-SaaS服务,通过 EC-SaaS与云端SaaS的协同实现面向客户的按需服务;云端主要提供SaaS服务在云端和边缘节点的服务分布策略,以及云端承担的SaaS服务能力。

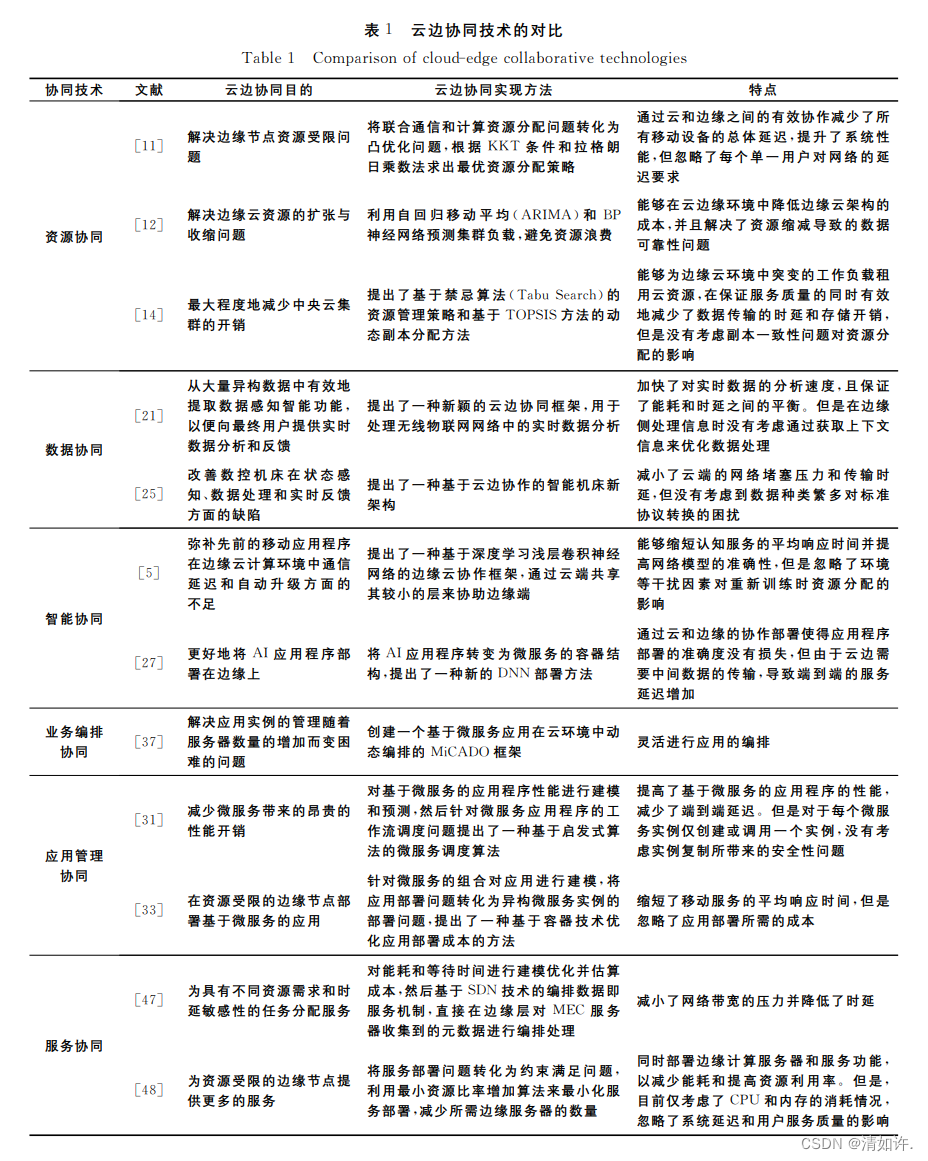

最后总结一下6种协同技术的对比。

3 边缘计算AI计算框架

在云数据中心中,算法执行框架更多地执行模型训练任务,在训练过程中需要接收大规模、批量化的信息数据,比较关注训练的迭代速度和收敛率等。而在边缘设备上更多的是执行预测任务,输入一般是实时的小规模数据,大多数场景下执行预测任务,因此更加关注于预测算法执行速度及端侧或边缘侧的资源开销。

目前业界针对边缘计算场景,也提出了针对性的设计方案,例如用于移动设备或嵌入式设备的轻量级解决方案TensorFlow Lite,Caffe2和Pytorch等。

结语

云边协同是一种新型计算范式,其将云计算强大的资源能力与边缘计算超低的时延特性结合起来,实现了边缘支撑云端应用,云端助力边缘本地化需求的协同优化目标。

AI和边缘计算已获得国内外学术界和工业界的广泛关注和认可,并且已经在很多商业场景下发挥作用。将AI应用部署至边缘已成为提升智能服务的有效途径。

尽管目前边缘智能仍处于发展的初期,然而,边缘智能够产生极大的促进效果,并成为各行各业的黏合剂和智能产业发展的催化剂,促进多个行业的升级转型。

参考资料:

- [1]华为云原生团队:AI 与边缘计算结合的双向优化

- [2]黄成龙,柯宇曦,华向东等.边缘计算在智慧农业中的应用现状与展望[J].农业工程学报,2022,38(16):224-234.

- [3]田鹏新,司冠南,安兆亮等.基于数据驱动的云边智能协同综述[J/OL].计算机应用:1-10[2023-03-28].http://kns.cnki.net/kcms/detail/51.1307.TP.20230314.1518.004.html.

- [4]陈玉平,刘波,林伟伟等.云边协同综述[J].计算机科学,2021,48(03):259-268.

- [5]刘耕,赵立君,陈庆勇等.联邦学习在5G云边协同场景中的原理和应用综述[J].通讯世界,2020,27(07):50-52.

本文内容由网友自发贡献,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系:hwhale#tublm.com(使用前将#替换为@)