一、论文信息:

二、背景与创新

-

背景:合成视频威胁到数字媒体的信任与隐私,许多deepfake检测方法使用单帧视频,并且只专注于图像中的空间信息或被操纵视频的时间不一致性来实现鉴伪,单模态。

-

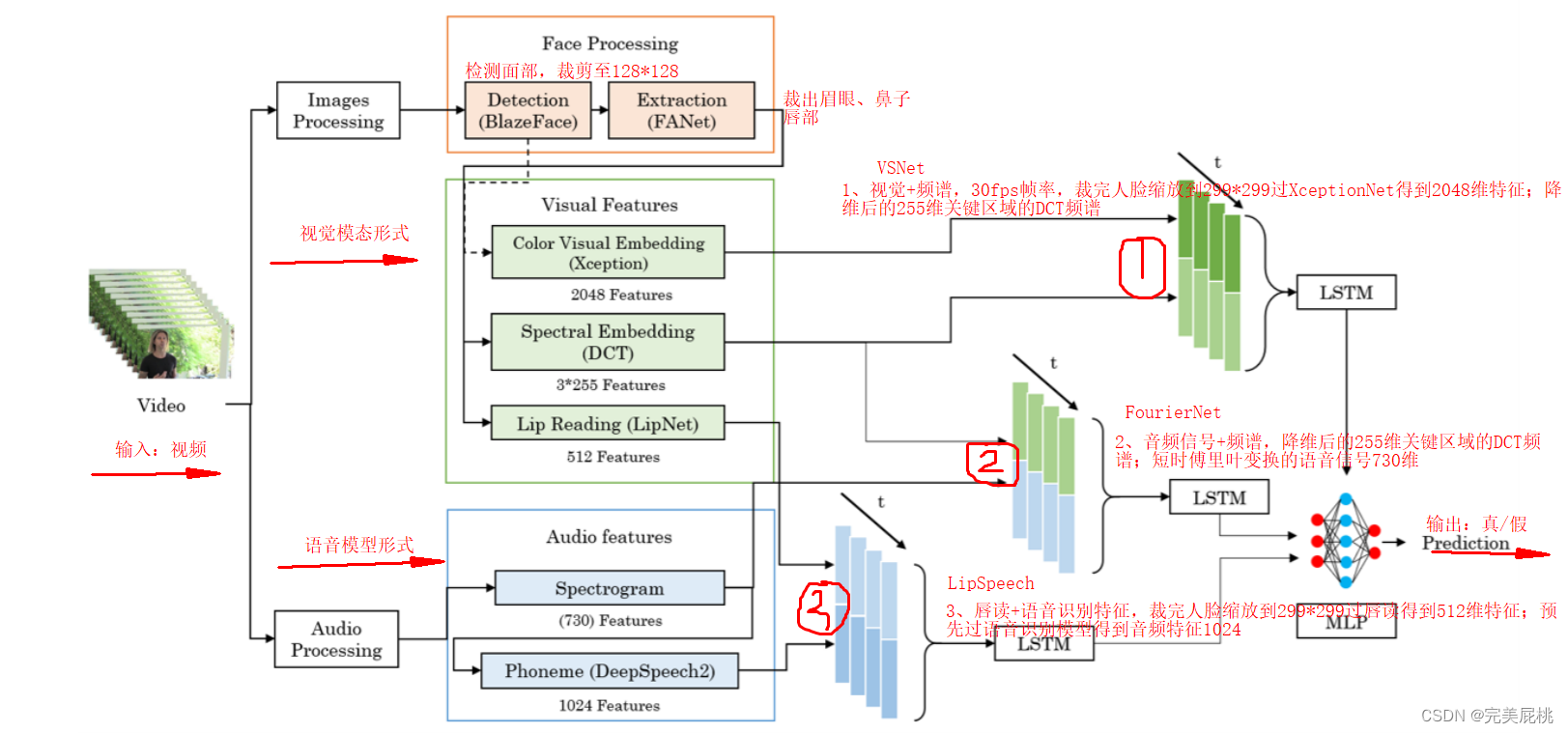

创新:作者提出一种混合深度学习方法,建立了一个多模态网络来检测深度伪造视频,主要包括三个子网络:唇读+语音识别特征、音频信号+频谱、视觉+频谱。

三、网络结构

NOLANet:

子网络

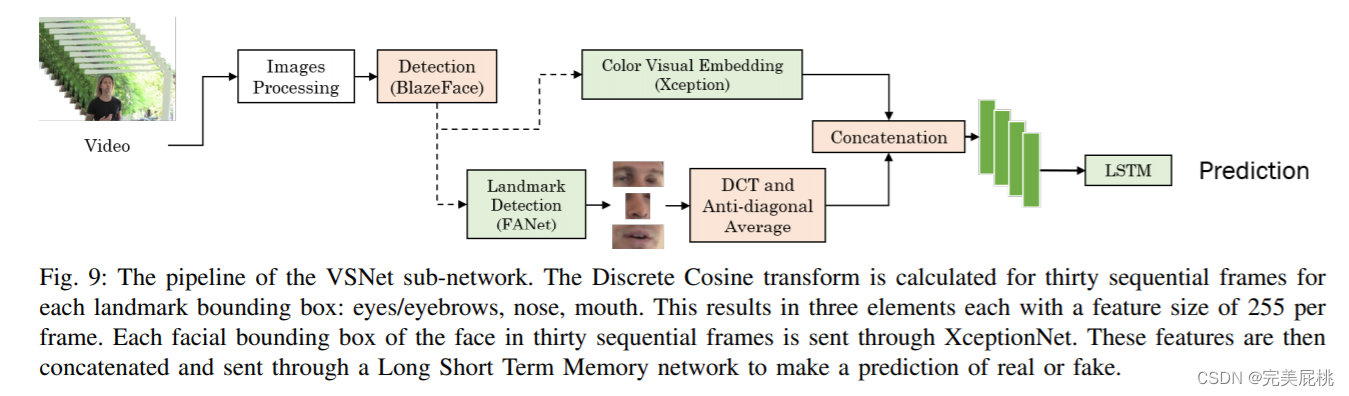

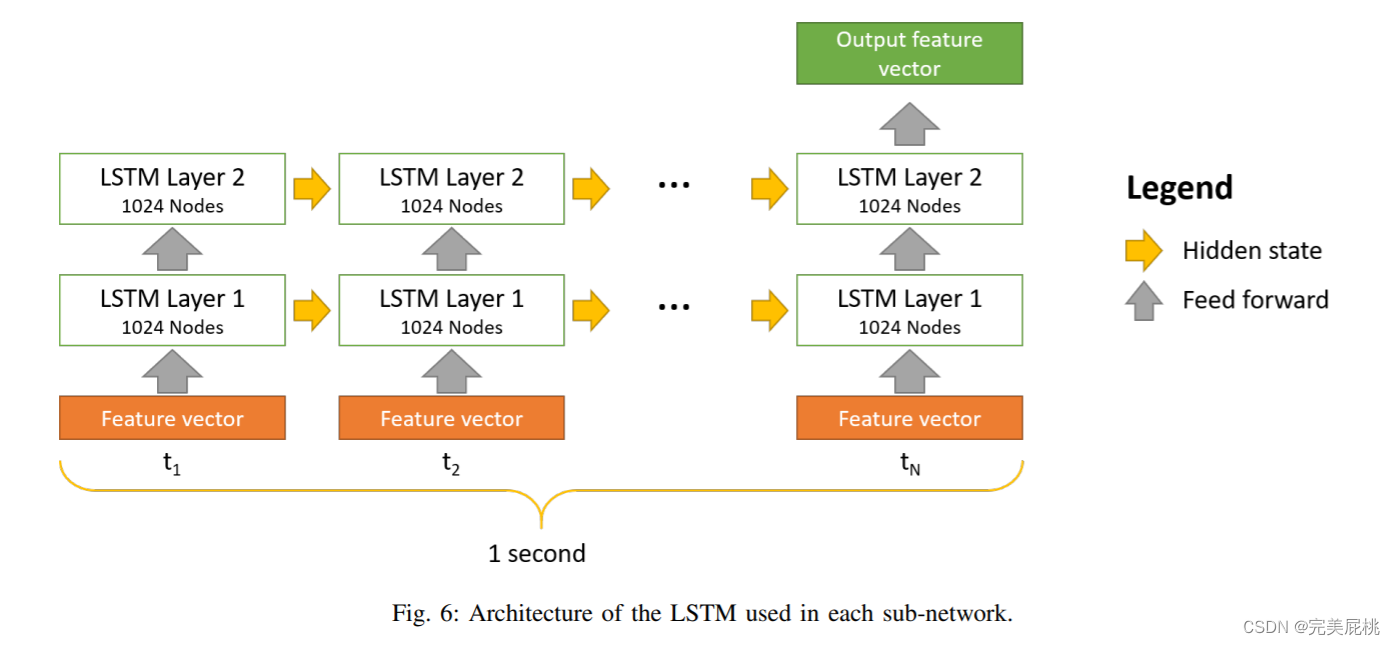

1)VSNet(视觉+频谱):该子网络仅评估视频的视觉特征所提供的消息。该子网络根据XceptionNet网络特征和1D DCT特征来估计时间特征。XceptionNet输出特征大小为2048,三个界标边界框的每个1D DCT的总和为765,这些特征被连接,总的输入大小为2324个特征,并输入到具有1秒时间窗口的LSTM做预测。

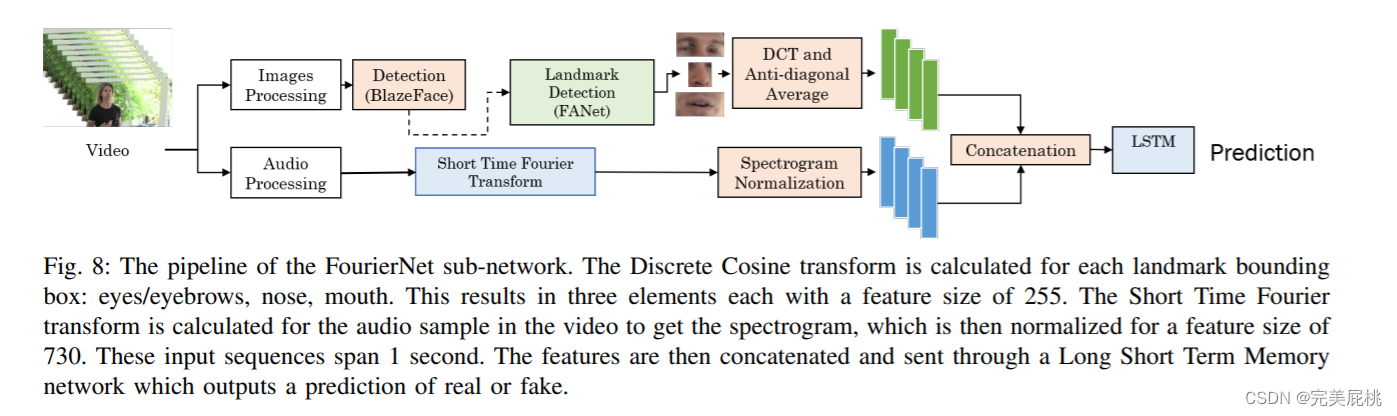

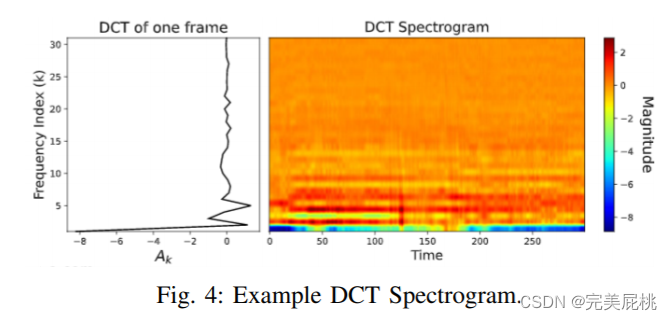

2)FourierNet(音频信号+频谱):傅里叶网络专注于视觉特征的频谱信息以及音频信号的频谱 ,视觉特征的频谱信息通过关键点的DCT和具有音频样本的短时傅里叶变换的音频的频谱信息来计算,每个输入的时间跨度为1秒,这些特征被连接起来,总特征大小为1495,并送进LSTM。

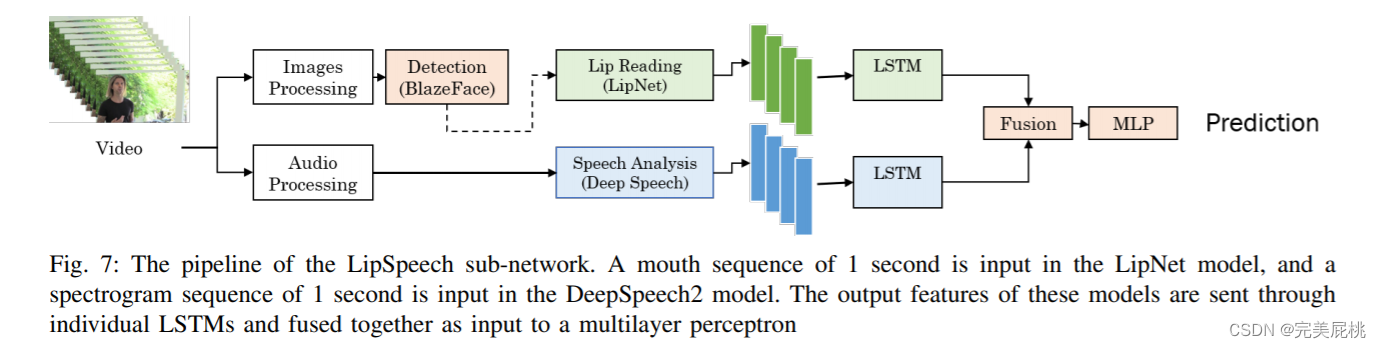

3)LipSpeech(唇读+语音):用于评估视觉数据与音频数据的对齐情况,即比较LipNet和DeepSpeech2的输出,LipNet是基于唇读预测文本,DeepSpeech2基于音频预测语音,两个子网络基于的假设为:分别固有的知道视位和音素,这些模型的每一个输入是1秒的序列,从而产生表示基于音频的1秒翻译文本和基于嘴部运动的1秒翻译文本的输出特征向量,并将其输入到LSTM中。

四、数据处理

1、输入输出:

2、数据处理或增广:

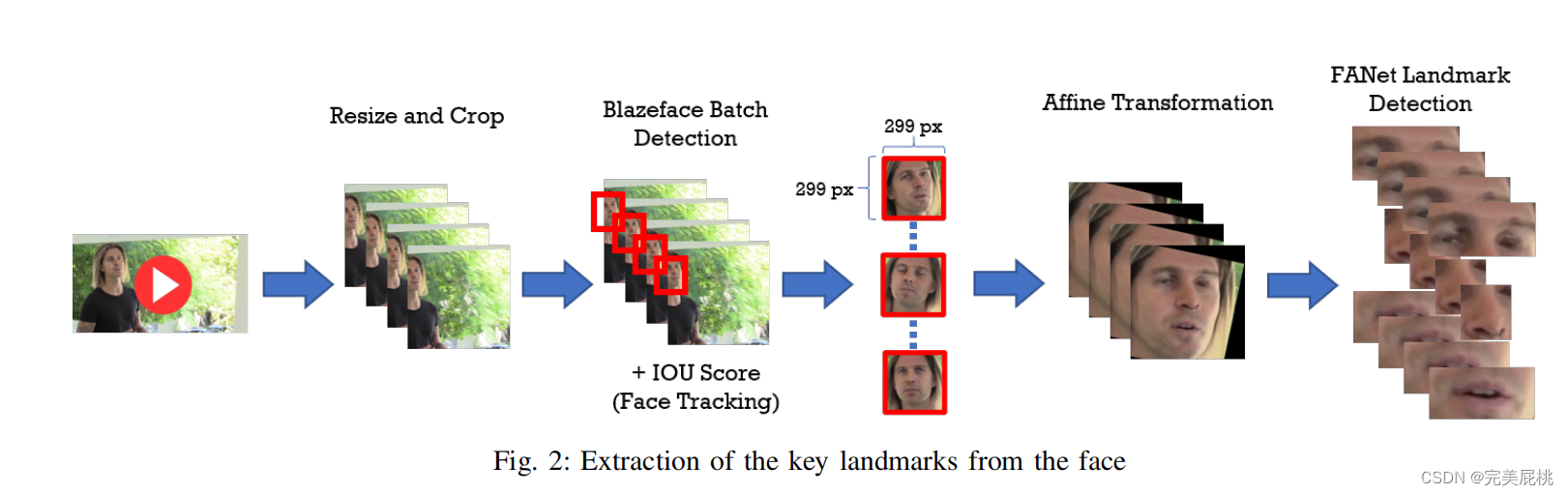

1)面部检测与关键点提取:每个面部区域被裁剪并调整到128x128像素,使用预训练BlazeFace模型提取面部区域。之后通过仿射变换缩放为299x299像素,在检测和保存面部之后,执行仿射变换归一化标志点的位置,再使用面部对准网络(FANet)检测面部标志,并分别裁出眉眼、鼻部和唇部。(眉眼/嘴2:1;鼻子1:1)

3、处理形式、训练策略:

1)视觉模态形式:

2)语音模型形式:

窗口大小:

输入的离散音频信号:

短时傅里叶变换:

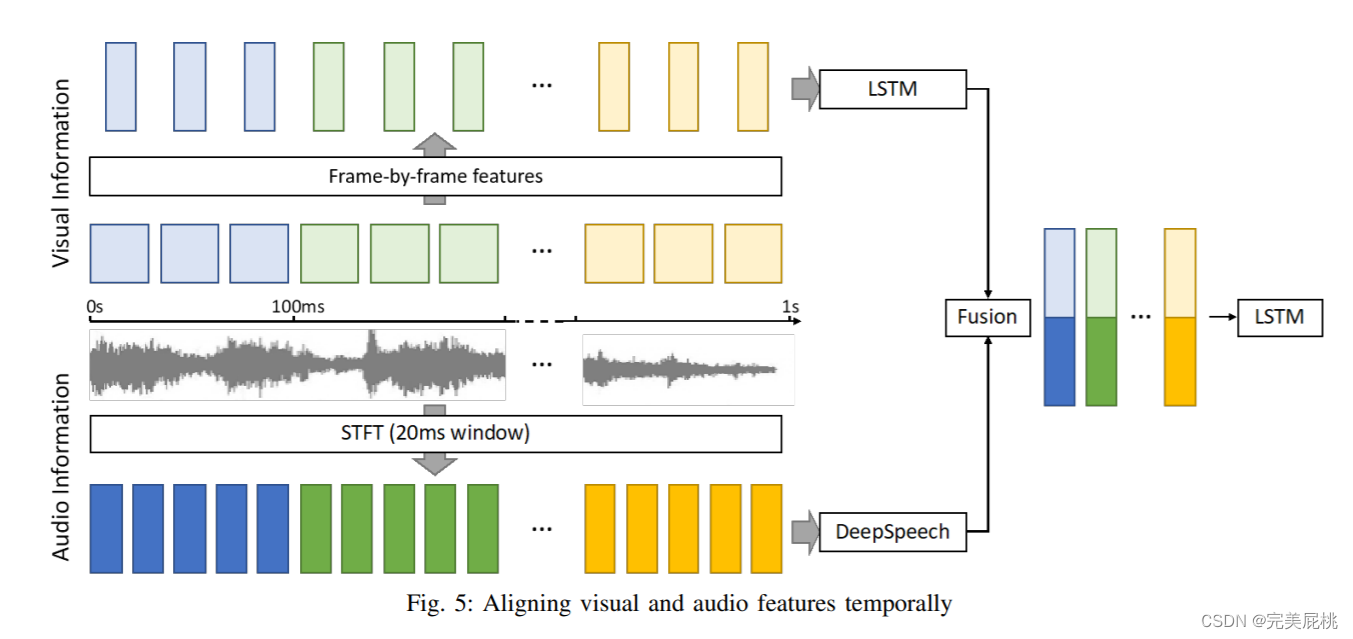

3)特征对齐:视频-音频对齐

4、损失函数:交叉熵损失

五、实验结果

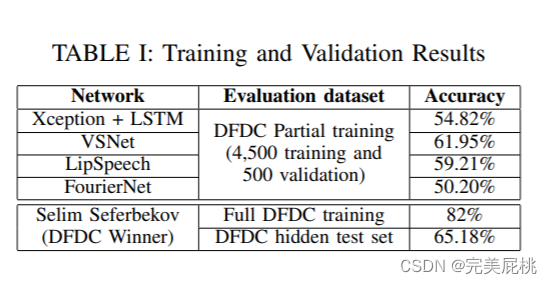

测试了每个子网络以分析其各自的贡献:

总结:XceptionNet与其他功能结合时性能更好,音频域的频谱特征和视觉域中的频谱特征之间没有相关性。

引用的各子网络