摘要

图神经网络在图结构数据中取得了很好的效果但是大多数的模型使用的还是叫浅层的结构,当模型层数加深时很容易过平滑。本文基于多视图来聚合更多的信息。我们首先设计两个互补的视图来描述全局结构和节点特征相似性,然后使用注意力策略融合节点表示。最后,通过在不同视图上使用对比学习来学习节点的表示。

引言

GCN是每层聚合一次一阶邻居的信息,通过增加层数迭代聚合邻居信息。但随着网络层数的增加,效果会严重下降。实验发现使用RELU作为激活函数的GCN随着层数的增加效果严重下降而使用其他激活函数图tanh有减缓过平滑的效果但是随着层数增加效果仍在下降。深层的GNN可以聚合高阶邻居的信息但这些信息可能包含噪声,会降低节点的可区分性。因此,现存GNN模型待处理两个问题:

1)如何聚合高阶邻居的特征?

2)如何区分不同邻居的贡献程度?

深度的GNN只处理了第一个问题,GAT等只处理了第二个问题。

为了解决上面两个问题,我们设计了两个新颖的GNN模型叫做MV-CGC和MV-GCN从多个视图中学习节点的表示。多视图表示学习就是为同一目标生成多个视图来学习。我们首先引入两个视图来表示全局关系和节点之间的特征关系作为邻接矩阵的补充。这三个视图可以分别从局部拓扑,全局拓扑和特征相似性的角度更加精确的描述了节点之间的关系。然后使用任何已有GNN模型在该三个视图上学习节点表示。模型可以从全局拓扑和特征相似视图中聚合高阶邻居的特征。然后使用注意力机制计算各个视图中节点表示的贡献度并聚合节点表示。进一步,我们引入了自监督技术通过在不同视图之间对比学习节点的表示。

模型

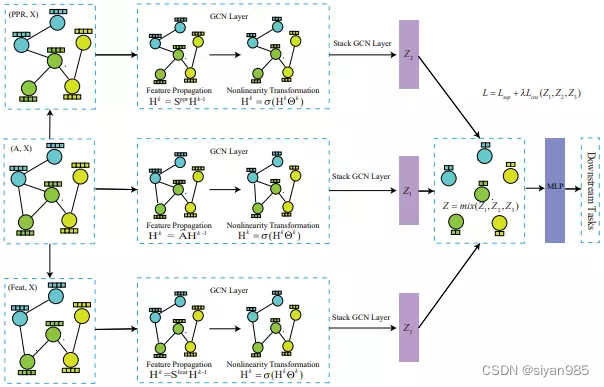

Multi-View Graph Convolutional Network(MV-GCN)

多视图学习是以一种基础的数据增强技术可以从不同角度描述数据。图建模的是关系,而这种关系是多样的,单一的视图很难精确描述,并且,网络中可能会有噪声。为丰富结点之间的关系,本文从高阶拓扑和特征相似性两个视角出发。基于原始邻接矩阵和原始特征生成两个视图并使用任何的GNN模型为每个视图生成对应的结点表示。之后,使用一个融合方法从三个视图中融合结点的表示,最终将学到的表示用于下游任务。

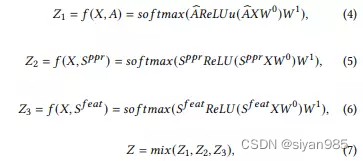

由于传统的GCN能捕获结点的阶数和模型的层数一致,当层数加深时会出现过拟合,因此,本文采用高阶的拓扑矩阵来表示全局关系。随机游走是一种获取高阶拓扑结构的方法。本文采用个性化PageRank获取扩散矩阵来表示全局的结构。为每个结点选择最相似的k个结点得到全局相似矩阵。然后使用余弦相似度评估结点的特征相似性,为每个结点选择top k个最相似的结点作为邻居。在得到三个视角后,为每个视图使用GNN经计算三组结点表示最后融合三组表示得到最终结点表示。其过程如下式:

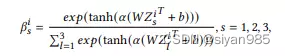

其中,mix函数可以使用拼接,平均等操作,本文采用注意力机制学习结点表示在不同视图下的重要程度。比如,对于结点i,可以得到三个表示

,s=1,2,3。注意力权重计算如下

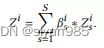

最终结点的表示定义为

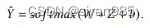

经过线性变换使用交叉熵分类

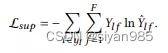

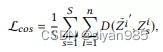

同一结点不同视图的表示应该是相似的,本文使用一致性正则loss降低不同视图结点表示之间的分布差异

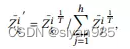

为了降低熵,本文还在embedding分布上使用了一个尖锐的函数。

最终的loss为

Multi-View Contrastive Graph Convolutional Network(MV-CGC)

传统的监督学习要求大量的标记样本才能达到较好的效果但是现实场景中充斥着大量的无标签数据,而标记这些数据需要很高的代价。MVGRL通过对比图的结构化视图学习结点和图的表示,具体就是在邻接矩阵和扩散矩阵上使用GCN学习结点和图的表示。但是该方法只考虑了局部结构和全局结构并没有考虑到结点的属性相似性 。基于此考虑,本文通过对比三个视图上同一实体来学习结点的表示 。

值得注意的是,视角数量超过两个并不能提升MVGRL的效果,甚至还有负作用。但在我们的工作中却恰恰相反。主要原因是在MVGRL中使用了两个扩散矩阵来表示局部和全局邻接矩阵但是这两个矩阵不是互补的,对对比效果甚至会有影响。但是我们使用了三个互补的视图,特征相似性视图可以为那些结构上不连接但标签相同特征相似的结点建立紧密的关系。

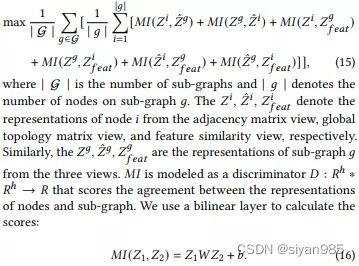

类似于MVGRL,本文通过最大化不同视图之间子图级表示和节点级表示的互信息学习样本的表示。具体来说,首先计算全局结构矩阵和特征相似度矩阵,然后从原图中采样子图并使用三个独立的GCN从三个视角中学习结点和子图的表示。最后使用readout函数得到子图的表示。最终,通过最大化子图的表示和对应结点的表示之间的互信息来区分实体的表示。

本文通过随机扰动特征来生成正样本。在预测阶段,聚合三个视图上的结点表示并经过MLP+softmax预测最终的标签信息。

实验

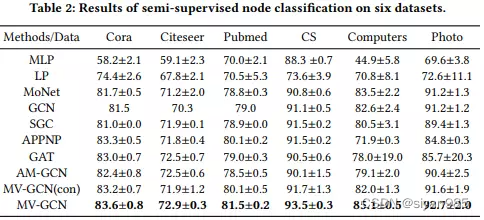

semi-supervised classfication

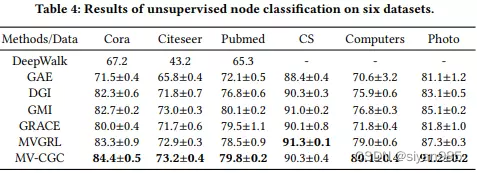

unsupervised classification

本文内容由网友自发贡献,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系:hwhale#tublm.com(使用前将#替换为@)