Paper name

WoodScape: A multi-task, multi-camera fisheye dataset for autonomous driving

Paper Reading Note

URL: https://openaccess.thecvf.com/content_ICCV_2019/papers/Yogamani_WoodScape_A_Multi-Task_Multi-Camera_Fisheye_Dataset_for_Autonomous_Driving_ICCV_2019_paper.pdf

GITHUB_URL: https://github.com/valeoai/WoodScape

数据集官网: https://woodscape.valeo.com

TL;DR

- 2019 年 ICCV 文章,出自于德国 Valeo 自动驾驶公司,提出了首个基于鱼眼相机采集的自动驾驶数据集 woodscape(取名致敬鱼眼镜头发明者 Robert_W._Wood)

- 适用于多个视觉任务:分割、深度估计、3D 包围框检测、镜头污渍检测等。分割标注在 instance level 有40类标注,提供了 10000 张图片,其他任务提供了 100000 张图片(其实并没有完全开源,比如雷达数据没有开源,总数据集数目大概是 10000 张左右)

- 鼓励在进行畸变校正的情况下进行视觉处理

Introduction

- 鱼眼相机和传统使用透视投影的针孔相机不一样,是使用非线性的投影来得到一个非常大的 FOV

- 该数据集适用于多个视觉任务:分割、深度估计、3D 包围框检测、镜头污渍检测等。分割标注在 instance level 有40类标注,提供了 10000 张图片,其他任务提供了 100000 张图片(其实并没有完全开源,比如雷达数据一点都没有开源,总数据集数目大概是 10000 张左右)

- 主要贡献有:

- 提出首个 10000 数量级的鱼眼图像分割数据集

- 4 个鱼眼相机、9个视觉任务,鼓励多任务、多相机方面的研究

- 提出了一种新颖的镜头表面污渍检测任务,并提出了该任务的首个数据集

- 提出了一种训练速率提升 95x 的 3D 框检测方法

Dataset/Algorithm/Model/Experiment Detail

实现方式

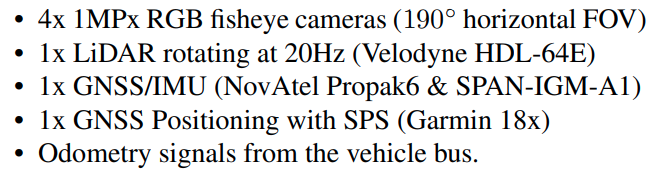

采集车传感器配置

- 前后左右分别安装一个鱼眼相机

鱼眼相机投影

- 鱼眼图像虽然 FOV 大,但成像模型较为复杂

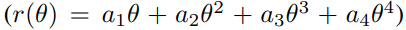

- 鱼眼畸变由径向映射函数

r

(

θ

)

r(\theta)

r(θ) 建模,

r

(

θ

)

r(\theta)

r(θ) 是图像上距畸变中心(光轴与图像平面的交点)的距离,是入射光线与相机光轴夹角

θ

\theta

θ 的函数

- 鱼眼相机投影方法

- 一般的鱼眼投影方法有:Stereographic projection、Unified Camera Model (UCM)、eUCM (Enhanced UCM),这些方法由于使用了特定的 geometry 所以并不完美适配鱼眼

- WoodScape 使用了 4阶多项式的映射函数,将入射角映射到图像像素

- 不同鱼眼相机投影的对比,其他投影模型参数都是优化到与 4 阶多项式投影对齐(入射角:0°与120°范围内,即 FOV 最大 240°)。

畸变校正 vs 模型适配畸变图像

- a 图是 rectilinear image 的简单畸变校正,缺点是降低了 FOV,且大于 180°的区域无法被正常校正,另外对于小区域 warp 到大区域的情况下有 resampling distortion

- b 图的 Piecewise linear correction 能解决 FOV 缺失问题,但是从一个平面到另一个平面的过度区域存在一些问题,可以看成是对鱼眼透镜模型的分段线性近似

- c 图展示了基于圆柱形视点进行的拟线性校正,在垂直方向是线性的,所以在垂直方向的竖直物体被较好保留,但是水平方向存在一些 distortion

- 由于畸变校正方法的本质缺陷,使用 CNN 来适配这种畸变也是一种思路,但是 CNN 的平移不变性在鱼眼这里不能被满足,因为鱼眼存在 spatially variant distortion,隐式学习这种畸变较为困难,最近的球形模型是一种解决思路但远远不够,这个方向还是 open problem

数据采集

- 大部分数据采集于: USA, Europe, and China(由于隐私问题不能开源)

- 虽然大部分数据来自轿车,但运动型多用途车的数据量很大,确保了传感器机械配置的充分性

- 采集设备

- 语义分割类别分布

数据集对比

实验结果

Thoughts

- 非常全面的鱼眼数据集,支持多个任务,可惜开源工作不彻底,只开源了小部分数据(并且开源时间与承诺时间相比推迟了一年)

本文内容由网友自发贡献,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系:hwhale#tublm.com(使用前将#替换为@)