感谢陈老师给的机会,有幸能够参加2020年的DAC比赛。我在其中负责目标检测器的调试和量化。自己第一次接触量化这个任务,很多东西都是一点一点学。

一、量化基础

对于一个全精度的值

v

v

v,若量化步长为

s

s

s(也可理解为量化分辨率),正负量化层级(quantization levels )分别为

Q

P

Q_{P}

QP和

Q

N

Q_{N}

QN。则量化过程为:

v

ˉ

=

I

n

t

(

c

l

i

p

(

v

/

s

,

−

Q

N

,

Q

P

)

)

\bar{v}=Int(clip(v/s,-Q_{N},Q_{P}))

vˉ=Int(clip(v/s,−QN,QP)) 其中的

v

/

s

v/s

v/s将全精度值映射到了比特空间,进行端侧修剪之后,返回最近距离的整数。若使用

b

b

b表示量化位数,对于Activations对应的无符号数,有

Q

N

=

0

,

Q

P

=

2

b

−

1

Q_{N}=0,Q_{P}=2^b-1

QN=0,QP=2b−1;对于Weights对应的有符号数,有

Q

N

=

2

b

−

1

,

Q

P

=

2

b

−

1

−

1

Q_{N}=2^{b-1},Q_{P}=2^{b-1}-1

QN=2b−1,QP=2b−1−1(正侧缺1项)。

解量化操作为:

v

^

=

v

ˉ

×

s

\hat{v}=\bar{v}\times s

v^=vˉ×s 量化&运算过程如下图所示:

二、LSQ论文简介

这篇论文是IBM在2019年的ArXiv上放出来的论文,全名Learned Step Size Quantization。大概思想就是基于均匀量化,让网络自己去寻找每一层合适的量化步长

s

s

s。所以最核心的问题就是如何设定步长关于损失值L的梯度。

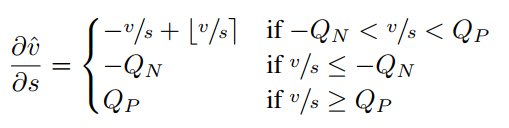

文中给出了解量化值

v

^

\hat{v}

v^关于

s

s

s的偏导的定义:

本文内容由网友自发贡献,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系:hwhale#tublm.com(使用前将#替换为@)