蓝色

紫色

红色

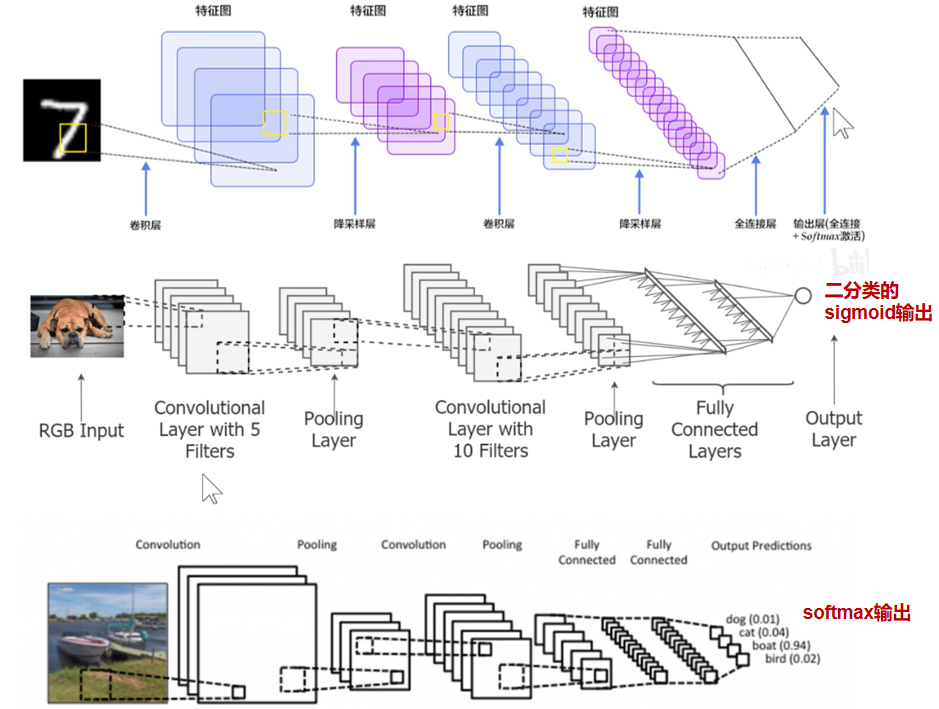

深度学习之卷积神经网络

基本的图像分类模型架构

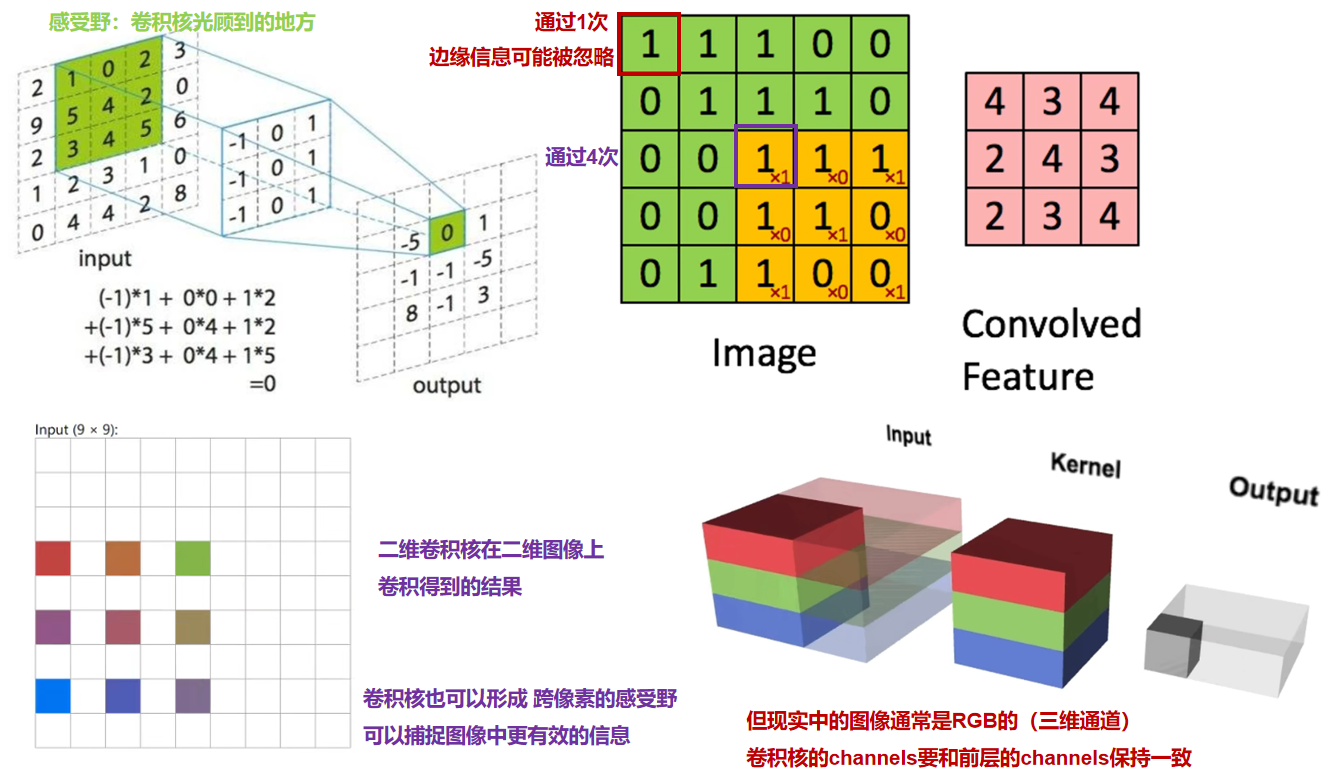

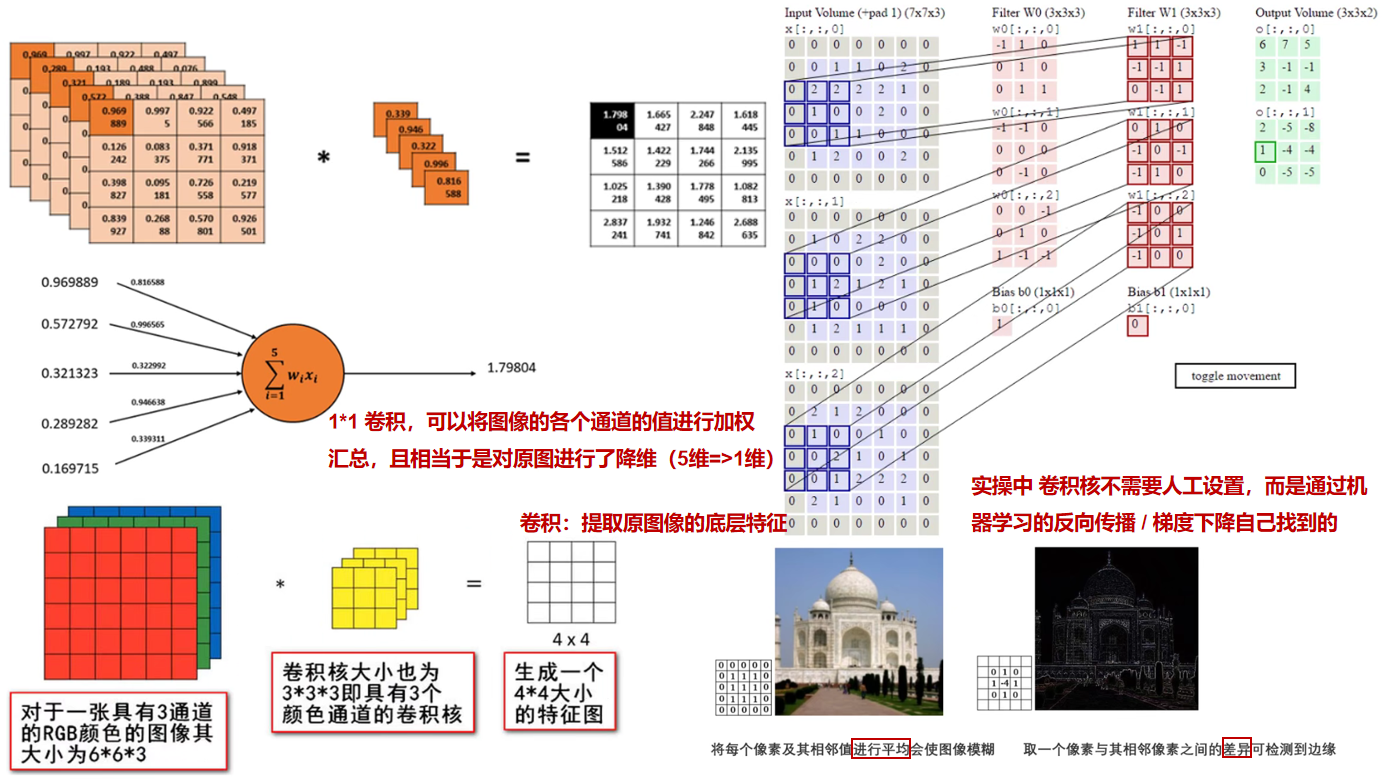

卷积层:用来提取图像的底层特征

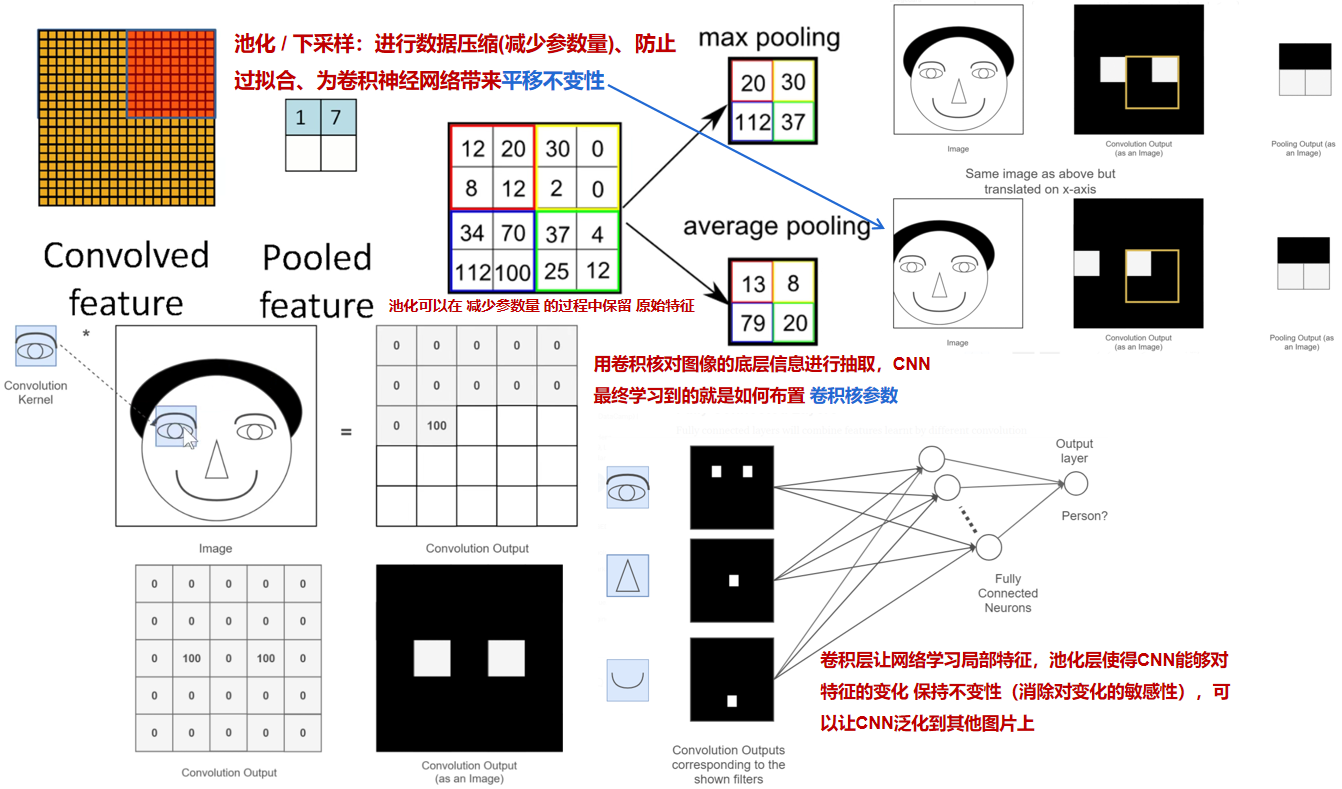

池化层:防止过拟合,减小数据维度

全连接层:汇总卷积层和池化层得到的底层特征和信息,再进行输出。

使用padding:为了防止边缘信息被忽略(让卷积核多通过它几次)

有多少个卷积核就有多少feature map,用很多卷积核生成的很多feature map 对原始图像的压缩和特征提取(卷积的工作)

池化

参考BLOG:Intuitive Guide to Convolution Neural Networks

神经网络核心要训练的东西:不论是卷积层还是全连接层的权重都是通过大量样本进行反向传播学习出来的,而非人为设定的。

关于CNN参数量的计算

卷积神经网络的参数计算

在设计神经网络结构时需要指定每个隐藏层权重矩阵、偏置项的维度,这个方法 可以快速确定每一层各个矩阵的维度。

一维卷积和二维卷积的区别(以Pytorch实现为例)

PyTorch实现MLP的两种方法,以及nn.Conv1d, kernel_size=1和nn.Linear的区别

一维卷积与二维卷积:Conv1d与Conv2d详解

nn.Conv1d()

参数介绍及图示、代码示例

简略版 参数比较

nn.Conv2d()

详细版 参数及计算

简略版 示例

nn.MaxPool1d

参数简要解释

本文内容由网友自发贡献,版权归原作者所有,本站不承担相应法律责任。如您发现有涉嫌抄袭侵权的内容,请联系:hwhale#tublm.com(使用前将#替换为@)