opencv之K-Means原理与实现方法(C++和python版本)

KMeans原理

今天记录一下opencv中kmeans中的原理以及图像分割的一个实例,K-Means是对数据进行分类的算法,属于无监督学习的一种。

首先需要确定对图像进行类别的数目确定,即需要知道几个类别,然后每个类别都有一个中心点

然后根据距离来决定每个数据点属于哪个类别标签,一次循环实现对所有数据点分类之后,直到指定的循环次数或者前后两次的delta小于指定阈值,停止计算得到最终的样本数据的标签。

先讲讲opencv中KMeans数据分类的函数:

OpenCV中KMeans数据分类的API为:

KMeans函数

double cv::kmeans(

InputArray data,

int K,

InputOutputArray bestLabels,

TermCriteria criteria,

int attempts,

int flags,

OutputArray centers = noArray()

)

data是输入的样本数据,必须是按行组织样本,每一行为一个样本数据,列表示样本的维度

K表示最终的分类数目

bestLabels 表示最终分类每个样本的标签(每个样本都有一个标签)

criteria 表示KMeans分割的停止条件

attempts 表示采样不同初始化标签尝试次数

flag表示中心初始化方法(有以下三种方法)

- KMEANS_RANDOM_CENTERS

- KMEANS_PP_CENTERS

- KMEANS_USE_INITIAL_LABELS

centers表示最终分割以后的每个cluster的中心位置

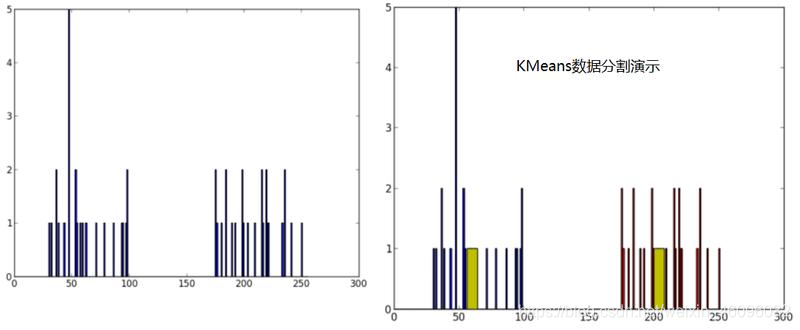

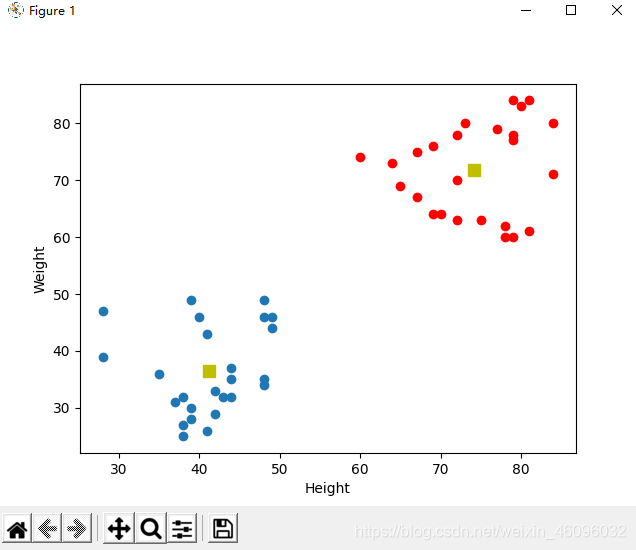

Kmeans数据分类演示,左图是数据坐标,可以理解为直方图,可以看出他是两个大类,而右图中黄色的是类的中心点

下面使用贾志刚老师的代码进行一个演示,先看python版本的

代码演示

1.python版本

导入必须的库

import numpy as np

import cv2

from matplotlib import pyplot as plt

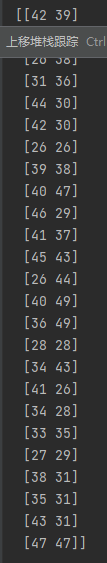

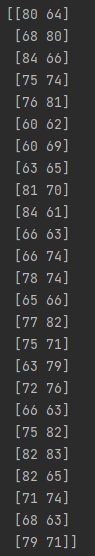

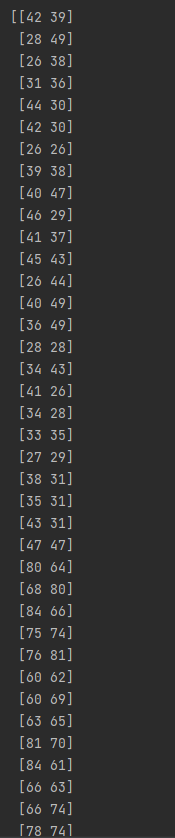

初始化为25行两列,X范围是25-50的范围,Y的取值范围是60-85。

X = np.random.randint(25,50,(25,2))

Y = np.random.randint(60,85,(25,2))

pts = np.vstack((X,Y))

# 初始化数据

data = np.float32(pts)#必须是一个浮点数数据

print(data.shape)

生成的Y

pts = np.vstack((X,Y))会将其两组数据叠加在一起

定义停止条件

criteria = (cv2.TERM_CRITERIA_EPS + cv2.TERM_CRITERIA_MAX_ITER, 10, 1.0)#计算10次,且差值小于1.0时停止计算

ret,label,center=cv2.kmeans(data,2,None,criteria,2,cv2.KMEANS_RANDOM_CENTERS)

print(len(label))

print(center)

获取不同标签的点,标签为0或者1

A = data[label.ravel()==0]

B = data[label.ravel()==1]

最后绘制图片

plt.scatter(A[:,0],A[:,1])

plt.scatter(B[:,0],B[:,1],c = 'r')

plt.scatter(center[:,0],center[:,1],s = 80,c = 'y', marker = 's')

plt.xlabel('Height'),plt.ylabel('Weight')

plt.show()

分类的结果如图所示

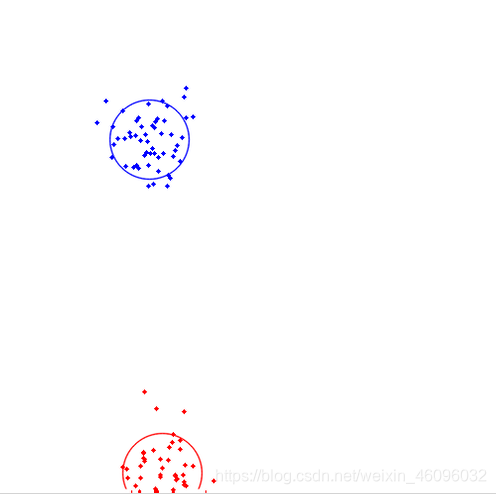

2.C++版本

相当于python版本,C++版本写起来区别会大很多,下面开始吧

#include <opencv2/opencv.hpp>

#include <iostream>

using namespace cv;

using namespace std;

int main(int argc, char** argv) {

Mat img(500, 500, CV_8UC3);

RNG rng(12345);

Scalar colorTab[] = {

Scalar(0, 0, 255),

Scalar(255, 0, 0),

};

int numCluster = 2;

int sampleCount = rng.uniform(5, 500);

Mat points(sampleCount, 1, CV_32FC2);

// 生成随机数

for (int k = 0; k < numCluster; k++) {

Point center;

center.x = rng.uniform(0, img.cols);

center.y = rng.uniform(0, img.rows);

Mat pointChunk = points.rowRange(k*sampleCount / numCluster,

k == numCluster - 1 ? sampleCount : (k + 1)*sampleCount / numCluster);

rng.fill(pointChunk, RNG::NORMAL, Scalar(center.x, center.y), Scalar(img.cols*0.05, img.rows*0.05));

}

randShuffle(points, 1, &rng);

// 使用KMeans

Mat labels;

Mat centers;

kmeans(points, numCluster, labels, TermCriteria(TermCriteria::EPS + TermCriteria::COUNT, 10, 0.1), 3, KMEANS_PP_CENTERS, centers);

//points输入的样本数据,必须是按行组织样本,每一行为一个样本数据,列表示样本的维度;k表示最终的分类数目

//bestlabels表示最终分类每个样本的标签,criteria表示kmeans分割的停止条件 attempts表示采样不同初始化标签尝试次数,一般与K等值

//flag表示中心初始化方法,centers表示最终分割以后的每个cluster的中心位置

// 用不同颜色显示分类

img = Scalar::all(255);

for (int i = 0; i < sampleCount; i++) {

int index = labels.at<int>(i);

Point p = points.at<Point2f>(i);

circle(img, p, 2, colorTab[index], -1, 8);

}

// 每个聚类的中心来绘制圆

for (int i = 0; i < centers.rows; i++) {

int x = centers.at<float>(i, 0);

int y = centers.at<float>(i, 1);

printf("c.x= %d, c.y=%d", x, y);

circle(img, Point(x, y), 40, colorTab[i], 1, LINE_AA);

}

imshow("KMeans-Data-Demo", img);

waitKey(100000);

return 0;

}

相对于python,C++的演示效果可能不是那么理想,的确还是pytho的数据分析能力更强更简便啊