关于 ScienceQA

模仿 回答 ScienceQA 问题时的多跳推理过程。 ScienceQA 展示了以下功能的实用性 语言模型中的 CoT,因为 CoT 在少样本 GPT-3 中将问答性能提高了 1.20% 微调的 UnifiedQA 中为 3.99%。

思想链 (CoT)

。我们进一步 设计语言 模型学习生成讲座和解释作为

解释

和

讲座

主题和 他们的答案注释以及相应的

科学

,这是一个新的基准 由约 21k 多模态多项选择问题组成,其中包含一组不同的

科学问答 (ScienceQA)

模仿 回答 ScienceQA 问题时的多跳推理过程。 ScienceQA 展示了以下功能的实用性 语言模型中的 CoT,因为 CoT 在少样本 GPT-3 中将问答性能提高了 1.20% 微调的 UnifiedQA 中为 3.99%。

思想链 (CoT)

。我们进一步 设计语言 模型学习生成讲座和解释作为

解释

和

讲座

主题和 他们的答案注释以及相应的

科学

,这是一个新的基准 由约 21k 多模态多项选择问题组成,其中包含一组不同的

科学问答 (ScienceQA)

ScienceQA 数据集

ScienceQA 是从小学和高中科学课程中收集的,包含 21,208 个多模态 科学多项选择题。 在 ScienceQA 的问题中,10,332 个 (48.7%) 有图像上下文,10,220 个 (48.2%) 有文本上下文,6,532 人 (30.8%) 两者都有。 大多数问题都附有接地讲座(83.9%)和详细解释 (90.5%)。 讲座和解释提供 分别得出正确答案的一般外部知识和具体原因。 据我们所知,ScienceQA 是第一个大规模多模式数据集,用于注释讲座和答案解释。

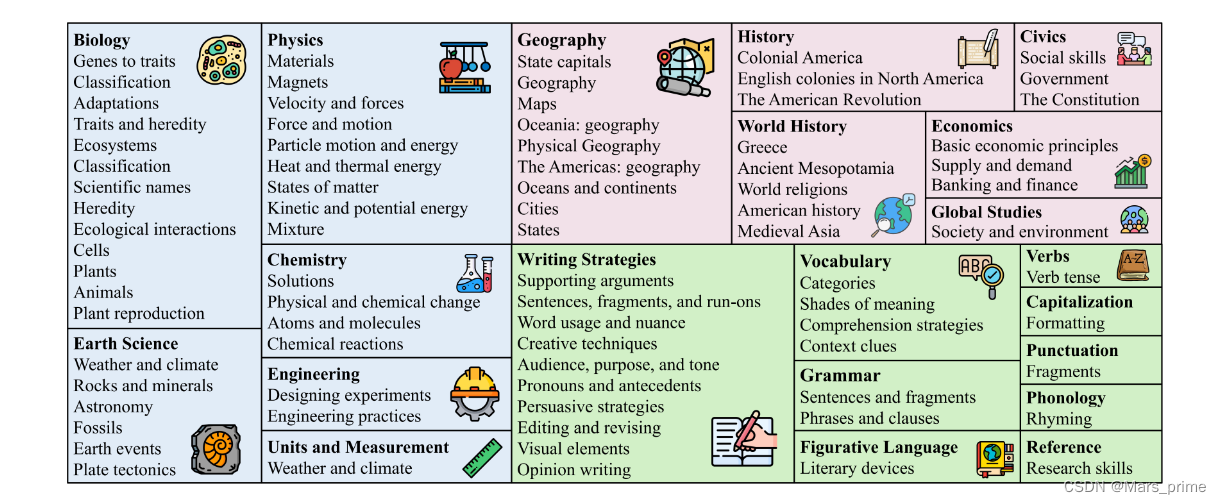

等)。 ScienceQA 具有 26 个主题、127 个类别和 379 项技能,涵盖广泛的领域。

识别 非洲国家

、

将水果和蔬菜分类为植物部分

、 等),最后通过技能(

动物

、

细胞

、

植物

等),然后按类别(

化学

、

物理学

、

生物学

。 每个主题中的问题首先按主题分类 (

社会科学

,以及

语言科学

,

自然科学

。

可视化

并

探索

。

可视化

并

探索

。

github 存储库

(Google 云端硬盘),或查看我们的

科学质量保证

执照。您可以从以下位置下载我们的数据集

CC BY-NC-SA(署名-非商业性-相同方式共享)

中提供!

HuggingFace 数据集

方法

我们通过思想链 (CoT) 构建一个小样本 GPT-3 模型,提示生成随后的答案 通过讲座和解释。

少样本 GPT-3 模型 (CoT) 在 ScienceQA 上达到了 75.17% 的最先进准确率。 一个预测示例如下所示。我们可以看到GPT-3(CoT) 预测正确答案并生成合理的讲座和解释来模仿人类 思考过程。

中报告 页。

Leaderboard